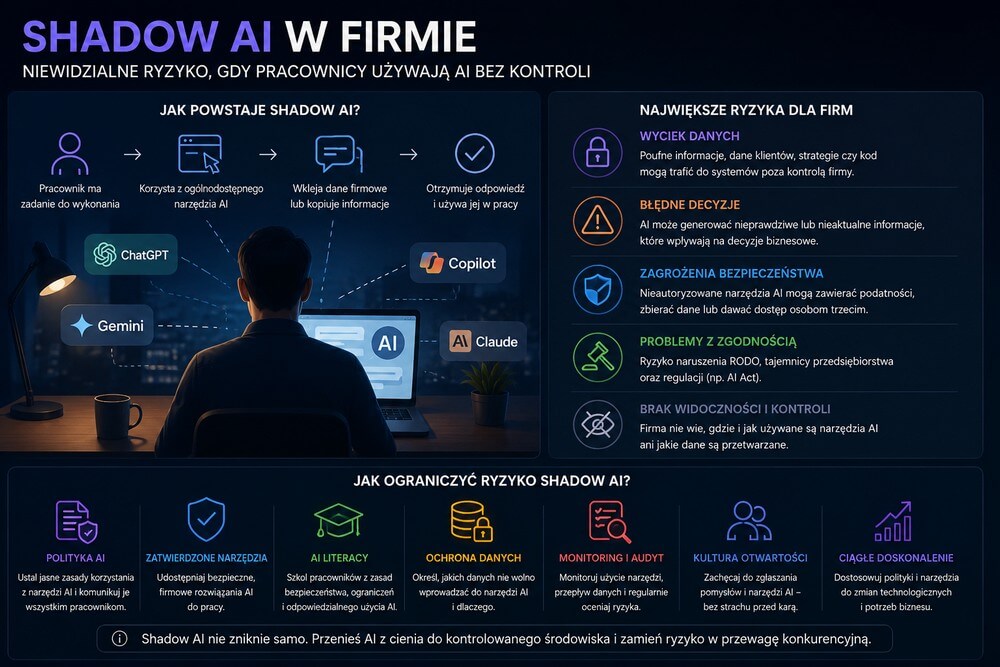

Shadow AI w firmie zaczyna się zwykle bardzo niewinnie. Ktoś chce szybciej napisać maila, streścić dokument, poprawić ofertę, sprawdzić fragment kodu albo przygotować prezentację. Otwiera ChatGPT, Gemini, Claude’a, Copilota lub inne narzędzie AI i po prostu działa. Problem w tym, że firma często nie wie, jakie dane trafiają do takich systemów, kto ma do nich dostęp i czy wygenerowane odpowiedzi są później sprawdzane.

Dla pracownika to sposób na szybszą pracę. Dla organizacji może to być jednak niekontrolowany obieg informacji, ryzyko ujawnienia poufnych danych, problemy z RODO, błędne decyzje oparte na odpowiedziach AI i brak jasnej odpowiedzialności. Szczególnie groźne jest to, że shadow AI nie wygląda jak klasyczny incydent bezpieczeństwa. Nie ma alarmu, awarii ani włamania. Jest codzienna praca, tylko wykonywana częściowo poza firmową kontrolą.

W tym artykule wyjaśniamy, czym jest shadow AI w firmie, jak działa w praktyce, dlaczego stało się jednym z najważniejszych tematów dla działów IT, prawnych, HR i zarządów oraz jak ograniczyć ryzyko bez zabijania sensownej adopcji sztucznej inteligencji.

Co to jest shadow AI?

Shadow AI to korzystanie z narzędzi sztucznej inteligencji w firmie bez wiedzy, zgody albo kontroli organizacji. Najprościej mówiąc: pracownik używa AI do zadań służbowych, ale firma nie wie, z jakiego narzędzia korzysta, jakie dane tam wpisuje, czy narzędzie jest zgodne z polityką bezpieczeństwa i czy wyniki są później weryfikowane. To może być szybkie streszczenie umowy w publicznym chatbocie, analiza danych klienta w zewnętrznej aplikacji, wygenerowanie treści sprzedażowej na prywatnym koncie albo przesłanie fragmentu kodu do asystenta AI.

To zjawisko przypomina wcześniejszy problem shadow IT. Kiedyś pracownicy korzystali z nieautoryzowanych aplikacji chmurowych, prywatnych dysków, komunikatorów czy arkuszy online, bo oficjalne narzędzia były zbyt wolne, niewygodne albo niedostępne. Dziś dzieje się podobnie, tylko stawką są dane wprowadzane do modeli AI, automatyczne decyzje, generowane treści, kod, dokumenty i wnioski biznesowe.

Shadow AI nie oznacza automatycznie złych intencji. Najczęściej wynika z presji czasu, ciekawości, potrzeby automatyzacji powtarzalnych zadań i braku jasnych reguł. Problem zaczyna się wtedy, gdy firma nie ma polityki AI, nie szkoli pracowników i nie wie, które procesy są już faktycznie wspierane przez sztuczną inteligencję. IBM w raporcie Cost of a Data Breach 2025 wskazuje, że AI rozwija się szybciej niż mechanizmy bezpieczeństwa i governance, a niezarządzane systemy AI są bardziej podatne na naruszenia i kosztowniejsze, gdy do nich dochodzi.

Jak działa shadow AI w praktyce?

Shadow AI działa bardzo prosto: pracownik napotyka zadanie, które chce wykonać szybciej, i sięga po narzędzie AI dostępne od ręki. Nie musi instalować specjalistycznego oprogramowania ani prosić działu IT o wdrożenie. Wystarczy przeglądarka, prywatne konto, rozszerzenie do Chrome, aplikacja mobilna albo darmowa wersja narzędzia generatywnego. Właśnie ta łatwość sprawia, że shadow AI rozprzestrzenia się szybciej niż klasyczne systemy firmowe.

Przykład? Pracownik działu sprzedaży wkleja do chatbota notatki ze spotkania z klientem i prosi o przygotowanie oferty. Osoba z HR wrzuca CV kandydatów do narzędzia, które ma pomóc w porównaniu kompetencji. Marketing generuje kampanię na podstawie nieopublikowanej strategii produktu. Programista przesyła fragment kodu, żeby znaleźć błąd. Prawnik streszcza projekt umowy w narzędziu, którego firma nigdy nie zatwierdziła. Każde z tych działań może być produktywne, ale każde może też powodować problem, jeśli zawiera dane osobowe, poufne informacje, tajemnice handlowe albo materiał objęty prawami autorskimi.

Mechanizm jest szczególnie ryzykowny, bo efekty użycia AI mogą trafić do finalnych dokumentów, ofert, prezentacji, kodu, analiz i decyzji bez oznaczenia, że powstały z pomocą modelu. Firma widzi gotowy rezultat, ale nie widzi procesu. Nie wie, czy źródło było bezpieczne, czy dane nie zostały zapisane w historii konta, czy model nie podał błędnych informacji, ani czy wygenerowana treść nie narusza czyichś praw. W praktyce shadow AI jest więc nie tylko problemem technicznym, ale także problemem zarządzania jakością pracy.

Dlaczego shadow AI jest ważne właśnie teraz?

Shadow AI stało się ważne teraz, bo tempo adopcji generatywnej sztucznej inteligencji wyprzedziło tempo tworzenia firmowych zasad. Pracownicy nie czekają, aż organizacja zakończy wdrożenie, wybierze dostawcę, przygotuje procedury i przeszkoli zespoły. Oni już korzystają z AI, bo narzędzia są tanie, łatwo dostępne i realnie pomagają w codziennych zadaniach. Microsoft wskazywał, że 60 proc. liderów martwiło się brakiem planu i wizji wdrożenia AI w firmie, podczas gdy pracownicy już używali tych narzędzi na dużą skalę.

Drugi powód to cyberbezpieczeństwo. World Economic Forum w kontekście Global Cybersecurity Outlook 2026 wskazuje, że 87 proc. badanych organizacji uważa, iż ryzyko związane z podatnościami AI wzrosło. WEF podkreśla też, że generatywna AI i systemy agentowe zmieniają krajobraz zagrożeń, bo mogą wspierać zarówno obronę, jak i ataki. Shadow AI wpisuje się w ten trend, ponieważ tworzy miejsca, których firma nie monitoruje i nie zabezpiecza.

Trzeci powód to regulacje. W Unii Europejskiej coraz większe znaczenie ma AI Act, w tym obowiązek AI literacy. Komisja Europejska wyjaśnia, że artykuł 4 AI Act zaczął obowiązywać 2 lutego 2025 roku, a organizacje powinny podejmować działania zapewniające odpowiedni poziom kompetencji AI u osób korzystających z systemów AI w ich imieniu. Nadzór i egzekwowanie tych zasad przez krajowe organy ma rozpocząć się od sierpnia 2026 roku. To oznacza, że firmy nie mogą już traktować AI jako prywatnej zabawki pracowników.

Gdzie shadow AI pojawia się najczęściej?

Shadow AI najczęściej pojawia się tam, gdzie pracownicy mają dużo tekstu, danych, komunikacji i presję na szybkie efekty. Dlatego szczególnie podatne są działy marketingu, sprzedaży, obsługi klienta, HR, finansów, prawa, IT i zarządzania projektami. To właśnie tam AI daje natychmiastowe korzyści: pisze, streszcza, porównuje, analizuje, tłumaczy, porządkuje i generuje pomysły.

W marketingu shadow AI może oznaczać tworzenie tekstów reklamowych, opisów produktów, grafik, scenariuszy wideo i analiz konkurencji bez sprawdzenia praw autorskich, źródeł i zgodności z komunikacją marki. W sprzedaży może dotyczyć automatycznego przygotowywania ofert, maili follow-up, segmentacji klientów i podsumowań spotkań. W HR ryzyko rośnie przy przetwarzaniu CV, ocen pracowniczych, danych kandydatów i notatek z rozmów rekrutacyjnych. W IT problemem może być wklejanie fragmentów kodu, logów, błędów systemowych lub konfiguracji infrastruktury do publicznych narzędzi AI.

Najbardziej niebezpieczne są sytuacje, w których pracownik nie rozumie, że dane wpisane do narzędzia AI mogą mieć wartość biznesową albo prawną. To mogą być nie tylko dane klientów, ale też cenniki, marże, dokumenty strategiczne, informacje o produkcie przed premierą, zgłoszenia serwisowe, dane medyczne, finansowe, prawne lub techniczne. Firma może więc mieć do czynienia z realnym naruszeniem, mimo że pracownik chciał „tylko szybciej napisać maila”.

Największe zalety nieformalnego użycia AI

Choć shadow AI brzmi jak zagrożenie, nie można uczciwie mówić o tym zjawisku bez pokazania jego drugiej strony. Pracownicy sięgają po AI, bo często widzą realną wartość szybciej niż organizacja. Sztuczna inteligencja pomaga skrócić czas pracy nad dokumentami, uporządkować notatki, wygenerować pierwszą wersję tekstu, znaleźć błąd w kodzie, przygotować szkic prezentacji, stworzyć listę pomysłów albo przetłumaczyć materiał na inny język.

Nieformalne użycie AI bywa też sygnałem dla firmy. Pokazuje, gdzie oficjalne procesy są za wolne, które narzędzia są niewystarczające i w których działach istnieje największy potencjał automatyzacji. Jeżeli wiele osób korzysta z AI do streszczania spotkań, być może problemem jest przeciążenie komunikacją. Jeżeli zespół sprzedaży masowo generuje oferty w chatbotach, być może oficjalny CRM lub szablony ofertowe nie odpowiadają realnym potrzebom. Shadow AI może więc ujawnić prawdziwe tarcia operacyjne.

Najważniejsze korzyści, które firmy mogą z tego wyciągnąć, to:

- szybsze przygotowywanie pierwszych wersji dokumentów,

- lepsze porządkowanie informacji,

- wsparcie kreatywne dla marketingu i sprzedaży,

- automatyzacja powtarzalnych zadań,

- szybsze tłumaczenia i streszczenia,

- łatwiejsze prototypowanie pomysłów,

- większa samodzielność pracowników.

Problem nie polega więc na tym, że pracownicy używają AI. Problem polega na tym, że robią to bez zasad, bez świadomości ryzyka i często bez narzędzi zatwierdzonych przez firmę.

Największe ryzyka shadow AI

Największym ryzykiem shadow AI jest wyciek danych. Wystarczy, że pracownik wklei do zewnętrznego narzędzia fragment umowy, dane klienta, kod aplikacji, strategię cenową albo informacje o wewnętrznych procesach. Nawet jeśli dostawca narzędzia deklaruje pewne zabezpieczenia, firma może nie wiedzieć, jaki jest model przetwarzania danych, gdzie są przechowywane, kto ma do nich dostęp, czy są wykorzystywane do trenowania modeli i czy można je skutecznie usunąć.

Drugim ryzykiem są błędne odpowiedzi AI. Modele generatywne potrafią tworzyć teksty, które brzmią wiarygodnie, ale zawierają pomyłki, nieaktualne informacje, fałszywe źródła albo błędne interpretacje dokumentów. W zwykłym mailu może to być drobna wpadka. W analizie prawnej, finansowej, medycznej, technicznej albo strategicznej może to prowadzić do realnych strat. Shadow AI zwiększa to ryzyko, bo firma nie wie, które decyzje lub dokumenty były wspierane przez AI i czy ktoś je zweryfikował.

Trzecie ryzyko dotyczy zgodności z regulacjami i odpowiedzialności. Jeżeli firma korzysta z AI przy danych osobowych, procesach HR, obsłudze klienta, scoringu, analizie ryzyka albo automatycznym podejmowaniu decyzji, musi rozumieć kontekst prawny. NIST w projekcie Cyber AI Profile wskazuje, że organizacje potrzebują spójnego podejścia do zarządzania ryzykiem cyberbezpieczeństwa związanym z AI, a profil obejmuje m.in. zabezpieczanie komponentów AI, używanie AI w obronie cybernetycznej oraz przeciwdziałanie atakom wspieranym przez AI.

Shadow AI a dane osobowe, tajemnica firmy i RODO

Shadow AI jest szczególnie problematyczne wtedy, gdy pracownicy przetwarzają dane osobowe lub poufne informacje. Dane osobowe to nie tylko imię, nazwisko i adres e-mail. To także CV, numer telefonu, stanowisko, historia kontaktu z klientem, informacje o wynagrodzeniu, reklamacje, zgłoszenia serwisowe, dane zdrowotne, dane finansowe czy treści rozmów. Jeśli takie informacje trafiają do niezatwierdzonego narzędzia AI, firma może stracić kontrolę nad procesem przetwarzania.

Ryzyko nie kończy się na RODO. W wielu firmach jeszcze większym problemem może być tajemnica przedsiębiorstwa. Modele AI kuszą tym, że można wkleić do nich duży fragment tekstu i poprosić o analizę. Tyle że tym tekstem może być strategia produktu, projekt kampanii, analiza marż, dokumentacja techniczna, lista klientów, opis błędu bezpieczeństwa albo kod źródłowy. Jeżeli organizacja nie wie, że takie dane opuszczają kontrolowane środowisko, nie może ich chronić.

Praktyczna zasada jest prosta: do publicznych lub niezatwierdzonych narzędzi AI nie powinny trafiać dane osobowe, informacje poufne, dokumenty objęte tajemnicą, nieopublikowany kod, dane klientów, informacje finansowe ani materiały, których firma nie pokazałaby publicznie. To nie znaczy, że nie wolno używać AI w takich procesach. Oznacza to, że trzeba korzystać z rozwiązań zatwierdzonych, odpowiednio skonfigurowanych, objętych umowami, kontrolą dostępu i polityką bezpieczeństwa.

Shadow AI a cyberbezpieczeństwo

Shadow AI zwiększa powierzchnię ataku firmy. Każde niezatwierdzone narzędzie, wtyczka, konto, integracja albo aplikacja mobilna może stać się nowym punktem ryzyka. Działy bezpieczeństwa nie mogą chronić systemów, o których nie wiedzą. Nie mogą monitorować przepływu danych do narzędzi, których nie mają na liście. Nie mogą też skutecznie reagować na incydent, jeśli nie wiedzą, że część pracy odbywa się poza firmowym ekosystemem.

Szczególnie ryzykowne są rozszerzenia przeglądarkowe i narzędzia połączone z pocztą, kalendarzem, CRM-em, dyskiem firmowym albo repozytorium kodu. Wiele takich rozwiązań obiecuje automatyczne streszczanie, pisanie odpowiedzi, analizę dokumentów czy generowanie raportów. Jeśli pracownik nada im zbyt szerokie uprawnienia, narzędzie może uzyskać dostęp do dużej ilości danych. Problem polega na tym, że z punktu widzenia użytkownika to „tylko pomocnik AI”, a z punktu widzenia bezpieczeństwa — dodatkowy dostawca z dostępem do informacji.

IBM w raporcie Cost of a Data Breach 2025 podaje, że 97 proc. organizacji, które zgłosiły incydent bezpieczeństwa związany z AI, nie miało właściwych kontroli dostępu AI. Ten sam raport wskazuje, że 63 proc. organizacji nie miało polityk governance do zarządzania AI lub zapobiegania rozrostowi shadow AI. To mocny sygnał, że problem nie dotyczy wyłącznie samej technologii, lecz braku zasad, nadzoru i odpowiedzialności.

Shadow AI a AI Act i obowiązek AI literacy

W kontekście europejskim shadow AI trzeba łączyć z AI Act, zwłaszcza z obowiązkiem AI literacy. Komisja Europejska wyjaśnia, że dostawcy i podmioty wdrażające systemy AI powinny zapewniać odpowiedni poziom kompetencji AI u personelu oraz innych osób używających AI w ich imieniu. Obowiązek ten obowiązuje od 2 lutego 2025 roku, natomiast nadzór i egzekwowanie przez krajowe organy mają ruszyć od sierpnia 2026 roku.

To jest bardzo ważne dla firm, bo shadow AI często wynika nie ze złej woli, lecz z niewiedzy. Pracownik może nie rozumieć, że wklejenie danych klienta do chatbota jest ryzykowne. Może nie wiedzieć, że wygenerowana odpowiedź wymaga sprawdzenia. Może nie odróżniać narzędzia firmowego od prywatnego, darmowej wersji od środowiska enterprise, ani modelu wspierającego pisanie od systemu podejmującego decyzje. AI literacy ma właśnie zmniejszać tę lukę.

Dobra polityka AI nie powinna więc ograniczać się do zakazów. Powinna jasno tłumaczyć, czym jest AI, kiedy można z niej korzystać, jakich danych nie wolno wpisywać, które narzędzia są zatwierdzone, kto odpowiada za weryfikację wyników i w jakich procesach AI wymaga dodatkowej kontroli. Firmy, które potraktują AI literacy jako realne szkolenie operacyjne, a nie formalny slajd do odhaczenia, będą miały większą szansę ograniczyć shadow AI bez blokowania produktywności.

Jak firmy mogą wykrywać shadow AI?

Wykrywanie shadow AI powinno zacząć się od rozmowy, nie od polowania na winnych. Jeśli firma od razu wprowadzi atmosferę kontroli i kar, pracownicy zaczną ukrywać użycie AI jeszcze bardziej. Lepszym podejściem jest audyt potrzeb: które zespoły korzystają z AI, do czego, z jakich narzędzi, jakie dane przetwarzają i jakie problemy próbują rozwiązać. Celem nie jest zawstydzenie ludzi, ale zrozumienie realnego obiegu pracy.

Technicznie firma może korzystać z kilku metod. Dział IT może analizować ruch sieciowy do popularnych narzędzi AI, sprawdzać użycie rozszerzeń przeglądarkowych, monitorować aplikacje SaaS, kontrolować integracje z pocztą i dyskami oraz weryfikować, czy dane firmowe nie trafiają do niezatwierdzonych usług. W większych organizacjach przydatne są rozwiązania klasy CASB, DLP, EDR, zarządzanie tożsamością i kontrola uprawnień. Trzeba jednak pamiętać, że technologia nie zastąpi jasnej polityki.

Najlepszy efekt daje połączenie trzech elementów: audytu, zatwierdzonego katalogu narzędzi i edukacji. Pracownicy powinni wiedzieć, że firma nie zabrania AI z definicji, ale wymaga odpowiedzialnego użycia. Jeśli organizacja zapewni bezpieczne narzędzia, proste zasady i konkretne przykłady dozwolonych zastosowań, shadow AI zacznie maleć. Jeśli natomiast zostawi ludzi z samym zakazem, problem najpewniej przeniesie się do prywatnych kont i urządzeń.

Jak ograniczyć shadow AI bez blokowania innowacji?

Najgorszą reakcją na shadow AI jest prosty zakaz wszystkiego. Taki zakaz może wyglądać dobrze w procedurze, ale w praktyce często nie działa. Pracownicy nadal będą szukać sposobów na przyspieszenie pracy, szczególnie jeśli konkurencja, klienci i rynek oczekują większej efektywności. Rozsądniejsza strategia polega na stworzeniu bezpiecznych ścieżek korzystania z AI.

Firma powinna zacząć od klasyfikacji zastosowań. Inaczej należy traktować generowanie pomysłów na posty social media, inaczej analizę danych klientów, inaczej kod produkcyjny, a jeszcze inaczej procesy HR lub prawne. Niskiego ryzyka użycia można dopuścić szerzej, pod warunkiem weryfikacji efektów. Użycia średniego ryzyka powinny wymagać zatwierdzonych narzędzi i dodatkowych zasad. Użycia wysokiego ryzyka powinny mieć osobny proces oceny, dokumentacji i nadzoru.

Praktyczny model może wyglądać tak:

- lista zatwierdzonych narzędzi AI,

- prosta polityka „czego nie wolno wklejać do AI”,

- szkolenia AI literacy dla zespołów,

- zasady weryfikacji wygenerowanych treści,

- kontrola dostępu do narzędzi enterprise,

- proces zgłaszania nowych zastosowań AI,

- dokumentacja użycia AI w wrażliwych procesach,

- regularny przegląd ryzyka i dostawców.

Celem nie jest zatrzymanie AI. Celem jest przeniesienie jej z cienia do kontrolowanego, mierzalnego i bezpieczniejszego środowiska.

Co shadow AI oznacza dla pracowników?

Dla pracowników shadow AI oznacza przede wszystkim większą odpowiedzialność. Korzystanie z AI w pracy nie jest już neutralnym eksperymentem. Jeśli ktoś wkleja do narzędzia dane klienta, dokument firmowy albo poufną analizę, może nieświadomie naruszyć zasady bezpieczeństwa. Jeśli wykorzystuje wygenerowaną odpowiedź bez sprawdzenia, może wprowadzić błąd do oferty, raportu, kodu, prezentacji albo komunikacji z klientem.

Jednocześnie pracownicy nie powinni bać się AI. Dobrze używana sztuczna inteligencja może być świetnym wsparciem. Pomaga pisać pierwsze wersje tekstów, porządkować notatki, tworzyć konspekty, streszczać długie materiały, tłumaczyć, przygotowywać checklisty i analizować informacje. Warunek jest jeden: użytkownik musi rozumieć ograniczenia narzędzia. AI nie jest niezależnym ekspertem, który zawsze ma rację. To system generujący odpowiedzi na podstawie wzorców i danych, który może się mylić.

Najbezpieczniejsza zasada dla pracownika brzmi: używaj AI do wsparcia myślenia, ale nie oddawaj jej odpowiedzialności. Nie wpisuj danych poufnych do niezatwierdzonych narzędzi. Nie publikuj treści bez sprawdzenia. Nie traktuj odpowiedzi AI jako porady prawnej, medycznej, finansowej czy technicznej bez weryfikacji specjalisty. Nie ukrywaj użycia AI w procesach, w których firma wymaga transparentności. To proste reguły, które mogą uratować organizację przed bardzo drogimi problemami.

Co shadow AI oznacza dla firm?

Dla firm shadow AI oznacza, że adopcja sztucznej inteligencji już się dzieje — nawet jeśli zarząd jeszcze nie przyjął strategii. To bardzo ważna zmiana perspektywy. Organizacja może myśleć, że „nie wdrożyła AI”, ale jej pracownicy mogą już używać kilku lub kilkunastu narzędzi AI dziennie. Oficjalny brak wdrożenia nie oznacza braku ryzyka. Czasem oznacza tylko brak widoczności.

Firmy powinny potraktować shadow AI jako sygnał operacyjny. Jeśli ludzie używają AI po cichu, to znaczy, że widzą potrzebę automatyzacji, przyspieszenia pracy albo lepszego dostępu do wiedzy. Zamiast zaczynać od blokad, warto zapytać: które zadania są najbardziej uciążliwe? Gdzie AI realnie pomaga? Jakie dane są przy tym wykorzystywane? Które przypadki użycia można zalegalizować i zabezpieczyć? Które trzeba zatrzymać?

Z perspektywy zarządu shadow AI powinno trafić na styku czterech obszarów: bezpieczeństwa, prawa, HR i transformacji cyfrowej. To nie jest wyłącznie problem działu IT. Potrzebne są zasady, szkolenia, narzędzia, monitoring, umowy z dostawcami, ocena ryzyka i kultura pracy, w której pracownicy nie boją się mówić, jak naprawdę używają AI. Dopiero wtedy firma może przejść od niekontrolowanej improwizacji do świadomej adopcji.

Jak powinna wyglądać dobra polityka AI w firmie?

Dobra polityka AI powinna być krótka, zrozumiała i praktyczna. Jeśli dokument ma kilkadziesiąt stron prawniczego języka, pracownicy go nie przeczytają. Najlepsze polityki działają jak instrukcja codziennego użycia: pokazują, co wolno, czego nie wolno, kiedy trzeba zapytać przełożonego, które narzędzia są zatwierdzone i jakie dane są zakazane w publicznych systemach AI.

Polityka powinna zawierać co najmniej kilka elementów. Po pierwsze, definicję AI i shadow AI w prostym języku. Po drugie, listę zatwierdzonych narzędzi i informację, do jakich zadań można ich używać. Po trzecie, klasyfikację danych: publiczne, wewnętrzne, poufne, osobowe, wrażliwe. Po czwarte, zasady weryfikacji treści wygenerowanych przez AI. Po piąte, procedurę zgłaszania nowych narzędzi i przypadków użycia. Po szóste, odpowiedzialność: kto decyduje, kto zatwierdza i kto kontroluje.

Warto też dodać przykłady. Pracownik powinien zobaczyć jasny komunikat: „Możesz użyć AI do przygotowania szkicu ogólnego maila sprzedażowego, ale nie wpisuj danych klienta ani warunków negocjacji”. Albo: „Możesz poprosić AI o propozycję struktury artykułu, ale sprawdź fakty i źródła”. Albo: „Nie wklejaj do publicznego chatbota kodu produkcyjnego, logów systemowych ani danych dostępowych”. Konkret działa lepiej niż ogólne hasło o bezpieczeństwie.

Co może wydarzyć się dalej?

Fakty są takie: AI w pracy już jest powszechna, a firmy dopiero budują zasady jej stosowania. Raporty Microsoftu, IBM, WEF i dokumenty NIST pokazują ten sam kierunek z różnych perspektyw: pracownicy szybko adoptują AI, ryzyko cyberbezpieczeństwa rośnie, a organizacje potrzebują lepszego governance, kontroli dostępu, edukacji i strategii.

Prognoza jest ostrożna, ale dość oczywista: shadow AI nie zniknie samo. Będzie rosnąć wszędzie tam, gdzie oficjalne narzędzia są słabsze od publicznie dostępnych rozwiązań, a procedury są wolniejsze niż potrzeby pracowników. W kolejnych latach firmy prawdopodobnie będą coraz częściej wdrażać wewnętrzne platformy AI, firmowe chatboty, bezpieczne środowiska do pracy z dokumentami, katalogi zatwierdzonych narzędzi i szkolenia AI literacy. Można też oczekiwać większej presji ze strony audytorów, klientów i regulatorów.

Spekulacją byłoby twierdzenie, że każda firma zostanie ukarana za shadow AI albo że każde użycie publicznego chatbota skończy się wyciekiem. Tego nie da się uczciwie powiedzieć. Można natomiast powiedzieć, że brak zasad będzie coraz trudniejszy do obrony. Im bardziej AI wchodzi w procesy firmowe, tym mniej wiarygodne staje się tłumaczenie: „nie wiedzieliśmy, że pracownicy tego używają”.

Czytaj również: AI literacy obowiązek – czy firmy muszą szkolić pracowników z AI?

Podsumowanie i najważniejsze wnioski

Shadow AI w firmie to nie moda ani kolejny korporacyjny buzzword. To praktyczny problem firm, które chcą korzystać z produktywności sztucznej inteligencji, ale nie mają jeszcze kontroli nad tym, jak robią to pracownicy. Największe ryzyko nie polega na samym użyciu AI, lecz na nieświadomym wpisywaniu poufnych danych, braku weryfikacji wyników, niezatwierdzonych narzędziach i braku odpowiedzialności za proces.

Najrozsądniejsza strategia nie polega na całkowitym zakazie. Polega na przeniesieniu AI z cienia do oficjalnego obiegu: przez politykę AI, katalog zatwierdzonych narzędzi, szkolenia, kontrolę dostępu, audyt dostawców i jasne zasady dla pracowników. Firmy, które zrobią to wcześnie, mogą zyskać podwójnie: zwiększyć produktywność i ograniczyć ryzyko. Firmy, które będą udawać, że problemu nie ma, mogą odkryć shadow AI dopiero wtedy, gdy stanie się incydentem bezpieczeństwa, problemem prawnym albo reputacyjnym.

FAQ – shadow AI

Co to jest shadow AI?

Czy shadow AI jest niebezpieczne?

Dlaczego pracownicy używają AI bez zgody firmy?

Jak firma może ograniczyć shadow AI?

Czy warto pozwalać pracownikom na korzystanie z AI?

Źródła: