Serwery MCP stają się jednym z najważniejszych elementów nowej generacji narzędzi opartych na sztucznej inteligencji. Nie chodzi już tylko o chatboty, które odpowiadają na pytania. Chodzi o agentów AI, którzy mogą korzystać z dokumentów, baz danych, repozytoriów kodu, systemów firmowych, przeglądarki, narzędzi deweloperskich i usług chmurowych w ustandaryzowany sposób.

Model Context Protocol, czyli MCP, został zaprojektowany jako otwarty standard łączenia aplikacji AI z zewnętrznymi systemami. Oficjalna dokumentacja porównuje go do portu USB-C dla aplikacji AI: jeden wspólny sposób podłączania różnych źródeł danych i narzędzi zamiast dziesiątek osobnych integracji.

W tym artykule wyjaśniamy, czym są serwery MCP, jak działają, do czego można je wykorzystać, jakie przykłady najlepiej pokazują ich potencjał i dlaczego temat jest ważny właśnie teraz — szczególnie w kontekście agentów AI, automatyzacji pracy i bezpieczeństwa danych.

Co to są serwery MCP?

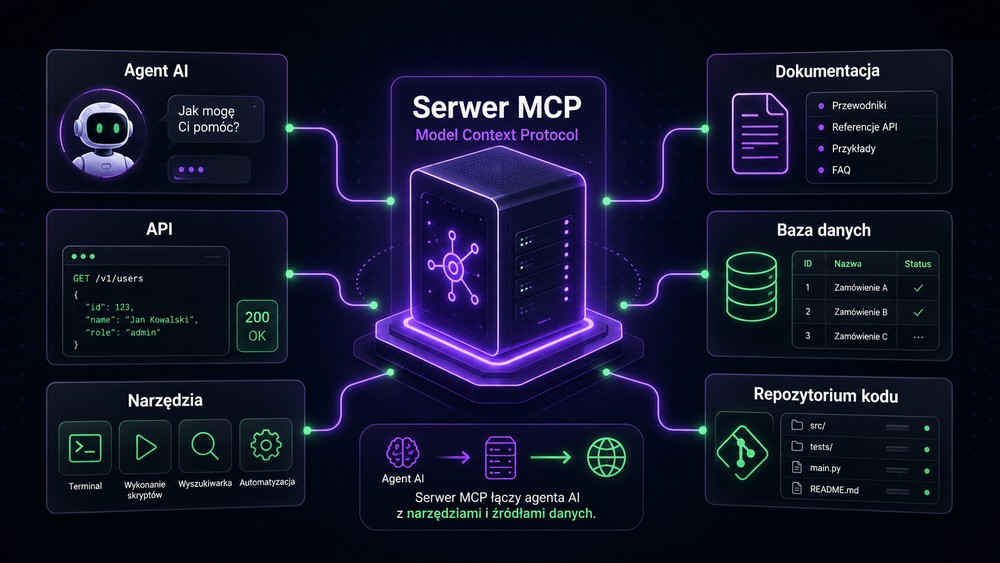

Serwer MCP to specjalny komponent, który udostępnia aplikacji AI określone dane, narzędzia lub akcje w zgodzie ze standardem Model Context Protocol. Najprościej mówiąc: serwer MCP jest „tłumaczem” między modelem językowym a konkretnym systemem zewnętrznym. Może łączyć agenta AI z dokumentacją, repozytorium kodu, bazą danych, CRM-em, systemem plików, usługą chmurową, wyszukiwarką, narzędziem analitycznym albo firmowym API.

W klasycznej aplikacji każda integracja wymagała osobnego podejścia. Jeżeli firma chciała podłączyć model AI do GitHuba, Google Drive, bazy PostgreSQL, wewnętrznego helpdesku i dokumentacji technicznej, często musiała tworzyć wiele różnych konektorów. MCP próbuje rozwiązać ten problem przez wspólny protokół. Oficjalna specyfikacja opisuje MCP jako standardowy sposób udostępniania kontekstu modelom, wystawiania narzędzi dla systemów AI oraz budowania integracji i przepływów pracy.

W architekturze MCP występują trzy główne role: host, klient i serwer. Hostem jest aplikacja AI, na przykład środowisko typu chatbot, IDE albo agent. Klient MCP działa po stronie tej aplikacji i utrzymuje połączenie z serwerem. Serwer MCP dostarcza zasoby, narzędzia i możliwości. To właśnie on mówi agentowi: „mogę przeszukać dokumentację”, „mogę pobrać plik”, „mogę utworzyć zgłoszenie”, „mogę sprawdzić koszt w chmurze” albo „mogę wykonać zapytanie do bazy danych”.

To ważne rozróżnienie, bo serwer MCP nie jest samym modelem AI. Nie zastępuje GPT, Claude’a, Gemini czy Copilota. Jest raczej warstwą dostępu do świata zewnętrznego. Model może rozumować, ale bez narzędzi ma ograniczone możliwości działania. Serwer MCP daje mu uporządkowany dostęp do kontekstu i operacji, które wcześniej trzeba było integrować ręcznie.

Może Cię zainteresować: Model Context Protocol (MCP) – co to jest, jak działa i do czego służy?

Jak działa Model Context Protocol?

MCP działa jako protokół komunikacyjny między aplikacją AI a zewnętrznym źródłem danych lub narzędziem. W aktualnej specyfikacji komunikacja opiera się na wiadomościach JSON-RPC 2.0, czyli lekkim formacie wymiany żądań i odpowiedzi używanym w wielu systemach programistycznych.

W praktyce wygląda to tak: użytkownik prosi agenta AI o wykonanie zadania, na przykład „sprawdź, jakie zmiany wprowadzono w tym repozytorium” albo „znajdź aktualną dokumentację dotyczącą tej funkcji”. Agent analizuje zadanie i sprawdza, jakie narzędzia są dostępne przez skonfigurowane serwery MCP. Jeżeli ma dostęp do odpowiedniego serwera, może wywołać konkretne narzędzie, pobrać wynik, a następnie wykorzystać go w odpowiedzi lub kolejnym kroku działania.

Serwer MCP może udostępniać kilka rodzajów elementów. Pierwsze to tools, czyli narzędzia, które model może wywołać. Drugie to resources, czyli zasoby, na przykład pliki, rekordy, dokumenty, konfiguracje lub dane. Trzecie to prompts, czyli gotowe instrukcje lub szablony wspierające powtarzalne zadania. Oficjalne SDK MCP wskazuje, że serwery mogą wystawiać narzędzia, zasoby i prompty, a także korzystać ze standardowych transportów, takich jak stdio, SSE i Streamable HTTP.

Najprostszy przykład? Agent AI w edytorze kodu może połączyć się z serwerem MCP dla dokumentacji technicznej. Zamiast zgadywać na podstawie wiedzy modelu, agent pobiera aktualny fragment dokumentacji, analizuje go i dopiero wtedy podpowiada kod. To zmniejsza ryzyko halucynacji, bo model nie bazuje wyłącznie na tym, co „pamięta”, lecz na konkretnym źródle.

Czym serwer MCP różni się od zwykłego API?

API to interfejs, przez który aplikacje komunikują się z konkretnym systemem. MCP też może korzystać z API, ale jego rola jest inna. Serwer MCP opakowuje dostęp do API, danych lub narzędzi w sposób zrozumiały dla aplikacji AI. Dzięki temu agent nie musi znać szczegółów każdego systemu osobno.

Można to porównać do różnicy między biblioteką pełną książek a bibliotekarzem, który zna układ półek, zasady wypożyczeń i potrafi znaleźć odpowiedni fragment. API jest jak konkretna półka z danymi. Serwer MCP działa bardziej jak bibliotekarz: udostępnia opis dostępnych narzędzi, przyjmuje ustandaryzowane żądania i zwraca wyniki w formie, którą agent może wykorzystać w dalszym rozumowaniu.

To szczególnie ważne w agentach AI, bo model nie tylko „wywołuje endpoint”. Musi wiedzieć, jakie narzędzie istnieje, kiedy go użyć, jakie argumenty przekazać i jak zinterpretować odpowiedź. OpenAI w dokumentacji Apps SDK opisuje MCP jako otwartą specyfikację do łączenia klientów LLM z zewnętrznymi narzędziami i zasobami; serwer MCP wystawia narzędzia, które model może wywołać podczas rozmowy.

Właśnie dlatego MCP jest często opisywany jako warstwa standaryzacji. Nie eliminuje API, ale może sprawić, że integracje AI będą bardziej przenośne. Ten sam typ serwera może działać z różnymi klientami MCP, na przykład w IDE, chatbocie, systemie agentowym albo narzędziu automatyzacji pracy.

Dlaczego serwery MCP są ważne właśnie teraz?

Serwery MCP stały się ważne, ponieważ rynek AI przesuwa się od prostych chatbotów w stronę agentów. Chatbot odpowiada na pytanie. Agent AI ma wykonać zadanie: sprawdzić dane, porównać dokumenty, przygotować zmianę w kodzie, uruchomić analizę, zarezerwować proces, stworzyć raport albo przeprowadzić użytkownika przez wieloetapowy workflow. Do tego potrzebuje dostępu do narzędzi i kontekstu.

Google w przewodniku dla deweloperów agentów AI pokazuje MCP jako jeden z kluczowych protokołów w rozwijającym się ekosystemie agentic AI. W tym samym materiale rozróżnia też inne protokoły, m.in. A2A do komunikacji między agentami oraz UCP/AP2 do scenariuszy handlu i płatności. MCP pełni tam rolę protokołu łączącego agenta z narzędziami i danymi.

Drugim powodem jest adopcja przez duże firmy. MCP pojawia się w dokumentacji OpenAI Agents SDK, Codex, Microsoft Learn, GitHub Copilot, Cloudflare, Docker i innych narzędzi dla deweloperów. OpenAI opisuje MCP jako sposób podłączenia modeli do narzędzi i kontekstu, a Microsoft Learn udostępnia własny serwer MCP do dostarczania aktualnej dokumentacji Microsoftu agentom i klientom zgodnym z MCP.

Trzecim powodem jest governance. W grudniu 2025 roku Anthropic przekazał MCP do Agentic AI Foundation działającej pod Linux Foundation. Według komunikatów Linux Foundation i Anthropic MCP stał się jednym z projektów założycielskich AAIF obok Goose i AGENTS.md, przy wsparciu firm takich jak OpenAI, Google, Microsoft, AWS, Cloudflare i Bloomberg.

Jakie problemy rozwiązują serwery MCP?

Największym problemem, który rozwiązują serwery MCP, jest chaos integracyjny. Firmy korzystają z wielu systemów: dokumentów, repozytoriów, baz danych, CRM-ów, systemów ticketowych, chmur, narzędzi BI, wewnętrznych paneli i aplikacji branżowych. Bez wspólnego standardu każdy agent AI wymaga osobnego zestawu integracji.

MCP pozwala budować integracje w bardziej modułowy sposób. Zamiast tworzyć osobny konektor dla każdej kombinacji „model + narzędzie”, można stworzyć serwer MCP dla konkretnego systemu. Potem różne aplikacje AI zgodne z MCP mogą z niego korzystać. To nie znaczy, że integracje stają się magicznie proste, ale zmienia się punkt ciężkości: mniej pracy idzie w powtarzanie tych samych połączeń, więcej w kontrolę uprawnień, jakość danych, bezpieczeństwo i projektowanie użytecznych narzędzi.

Serwery MCP rozwiązują też problem aktualności informacji. Model językowy może mieć ograniczoną lub nieaktualną wiedzę. Serwer MCP może dostarczyć aktualny kontekst z konkretnego źródła: dokumentacji, repozytorium, bazy danych albo systemu firmowego. Microsoft Learn MCP Server jest dobrym przykładem: jego celem jest dostarczanie agentom zaufanych i aktualnych treści z oficjalnej dokumentacji Microsoft Learn.

Trzeci problem to powtarzalność. Jeżeli agent ma wykonać konkretne zadanie, potrzebuje przewidywalnych narzędzi. Serwer MCP może wystawić jasno opisane funkcje, na przykład „wyszukaj dokument”, „pobierz artykuł”, „utwórz issue”, „sprawdź koszt”, „pobierz logi” albo „wykonaj zapytanie”. Dla firm to ważne, bo agenci AI bez kontroli nad narzędziami są efektowni w demonstracji, ale trudni do wdrożenia w realnym środowisku.

Najważniejsze elementy serwera MCP

Serwer MCP nie jest jednym typem aplikacji. Może być lokalnym procesem uruchomionym na komputerze dewelopera, usługą zdalną w chmurze albo zarządzanym komponentem dostarczanym przez platformę. Różni się zakresem, bezpieczeństwem i sposobem autoryzacji, ale ogólna idea pozostaje ta sama: serwer udostępnia agentowi narzędzia i kontekst.

Pierwszym kluczowym elementem są narzędzia, czyli akcje, które agent może wykonać. Narzędzie może wyszukać informacje, pobrać dane, uruchomić analizę, stworzyć rekord, zmienić konfigurację lub wywołać usługę zewnętrzną. W dobrze zaprojektowanym serwerze MCP narzędzia są wąskie, opisane i ograniczone uprawnieniami.

Drugim elementem są zasoby. To dane, które agent może odczytać albo wykorzystać jako kontekst. Mogą to być pliki, dokumenty, fragmenty kodu, rekordy z bazy danych, wpisy w dokumentacji, logi systemowe lub metadane. Zasoby są szczególnie ważne tam, gdzie model ma odpowiadać na podstawie aktualnych danych, a nie ogólnej wiedzy.

Trzecim elementem są reguły bezpieczeństwa i autoryzacji. Aktualna specyfikacja MCP obejmuje mechanizmy autoryzacji dla serwerów zdalnych. Dokumentacja wskazuje m.in. wymagania dotyczące OAuth 2.0 Protected Resource Metadata, co ma znaczenie przy budowie serwerów dostępnych przez sieć.

Czwartym elementem jest transport. Serwery MCP mogą działać lokalnie albo zdalnie. Lokalne są wygodne dla dewelopera, ale w firmach często potrzebne są serwery zdalne, centralnie zarządzane, audytowane i objęte politykami dostępu. Cloudflare i Microsoft opisują właśnie takie podejście w swoich materiałach dotyczących zdalnych serwerów MCP.

Przykład 1: Microsoft Learn MCP Server

Jednym z najlepszych przykładów praktycznego zastosowania MCP jest Microsoft Learn MCP Server. To zdalny serwer MCP, który dostarcza agentom AI zaufane i aktualne treści z dokumentacji Microsoft Learn. Microsoft opisuje go jako rozwiązanie kompatybilne z klientami takimi jak GitHub Copilot i innymi środowiskami agentowymi.

Dlaczego to ważne? Bo dokumentacja techniczna szybko się zmienia. Model językowy może znać starą wersję biblioteki, nieaktualną nazwę funkcji albo przestarzały sposób konfiguracji. Agent podłączony do oficjalnego serwera dokumentacji może pobrać aktualny artykuł, wyszukać przykłady kodu i oprzeć odpowiedź na źródle, które ma większą wiarygodność niż sama pamięć modelu.

Microsoft Learn MCP Server dobrze pokazuje przyszłość agentów AI w pracy technicznej. Programista nie musi ręcznie przeszukiwać dokumentacji, kopiować fragmentów i pytać modelu o interpretację. Agent może sam pobrać właściwy kontekst, porównać go z kodem i zaproponować poprawkę. To nie oznacza, że deweloper powinien bezrefleksyjnie akceptować każdą sugestię, ale skraca drogę od pytania do użytecznej odpowiedzi.

Ten przykład jest też ważny dla SEO i contentu technologicznego: MCP może ograniczać problem „AI mówi pewnie, ale nieaktualnie”. Jeżeli agent korzysta z zaufanego serwera dokumentacji, łatwiej wymusić, aby odpowiedź była oparta na aktualnym źródle. W środowiskach profesjonalnych to może być różnica między ciekawostką a narzędziem produkcyjnym.

Przykład 2: GitHub i serwery MCP dla pracy z kodem

Drugim mocnym przykładem są serwery MCP dla pracy z kodem i repozytoriami. GitHub wskazuje MCP jako sposób rozszerzania GitHub Copilot Chat o zewnętrzne narzędzia i kontekst. Dokumentacja GitHuba odsyła też do oficjalnej dokumentacji MCP oraz GitHub MCP Registry jako miejsca z serwerami od partnerów i społeczności.

W praktyce taki serwer może pozwolić agentowi analizować issue, pull requesty, pliki, historię zmian, zależności albo fragmenty dokumentacji projektu. To naturalny kierunek dla agentów programistycznych. Sam model językowy może napisać kod, ale dopiero dostęp do repozytorium pozwala mu zrozumieć kontekst projektu: strukturę katalogów, konwencje, istniejące funkcje, testy i ograniczenia.

To pokazuje, dlaczego MCP jest ważny dla narzędzi typu coding agent. Dobry agent programistyczny nie powinien działać jak generator losowych fragmentów kodu. Powinien rozumieć projekt, sprawdzać dokumentację, wykonywać testy, analizować błędy i proponować zmiany zgodne z kontekstem. Serwer MCP może być dla niego pomostem do tych informacji.

Jednocześnie to jeden z obszarów największego ryzyka. Dostęp do repozytorium, systemu plików albo narzędzi wykonujących komendy musi być bardzo ostrożnie kontrolowany. Historia bezpieczeństwa MCP pokazuje, że serwery związane z kodem i plikami mogą stać się atrakcyjnym celem ataków, szczególnie gdy agent ma możliwość wykonywania operacji na lokalnym środowisku. Dlatego w takich zastosowaniach konieczne są ograniczenia uprawnień, izolacja środowiska i potwierdzanie wrażliwych operacji przez człowieka.

Przykład 3: Cloudflare i zdalne serwery MCP

Cloudflare pokazuje inny kierunek rozwoju: zdalne, zarządzane serwery MCP. Firma opisuje MCP jako otwarty standard łączący systemy AI z zewnętrznymi aplikacjami, a w dokumentacji wskazuje katalog własnych zarządzanych serwerów MCP, z którymi można łączyć się m.in. przez OAuth w klientach obsługujących MCP.

To ważny przykład, bo wiele pierwszych wdrożeń MCP było lokalnych: użytkownik instalował serwer na swoim komputerze, konfigurował go i podłączał do klienta AI. Dla pojedynczego dewelopera to wygodne. Dla dużej organizacji — niewystarczające. Firmy potrzebują centralnego zarządzania, audytu, kontroli dostępu, rotacji tokenów, monitoringu i jasnych reguł bezpieczeństwa.

Zdalne serwery MCP przesuwają ten standard bliżej środowisk produkcyjnych. Agent AI może łączyć się z usługą przez sieć, a dostęp może być kontrolowany przez mechanizmy autoryzacji. To otwiera drogę do scenariuszy, w których agent nie jest dodatkiem do laptopa programisty, ale częścią firmowego procesu: analizuje logi, sprawdza konfigurację, wspiera obsługę klienta, porównuje dane lub pomaga w operacjach chmurowych.

Cloudflare zwraca też uwagę na bezpieczeństwo adopcji MCP w firmach. W jednym z materiałów firma opisuje MCP jako element strategii AI, ale jednocześnie podkreśla, że agentowe workflow z MCP wiążą się z ryzykami bezpieczeństwa. To dobry sygnał: dojrzałe wdrożenie MCP nie polega na tym, aby „podłączyć wszystko do AI”, tylko na tym, aby zrobić to z kontrolą i ograniczeniem skutków potencjalnych błędów.

Przykład 4: Docker MCP Catalog i problem zaufanych serwerów

Docker MCP Catalog pokazuje kolejny problem rynku: skąd brać zaufane serwery MCP i jak je uruchamiać bez chaosu środowiskowego. Docker opisuje swój katalog jako kuratorowaną kolekcję zweryfikowanych serwerów MCP pakowanych jako obrazy Docker i dystrybuowanych przez Docker Hub.

To brzmi technicznie, ale konsekwencja jest prosta. Jeżeli serwer MCP ma dostęp do danych, narzędzi albo kont użytkownika, nie powinien być przypadkowym skryptem pobranym z internetu. Firmy i deweloperzy potrzebują sposobu, aby szybciej znaleźć serwer, uruchomić go w przewidywalnym środowisku i ograniczyć ryzyko konfliktów zależności, błędnej konfiguracji lub złośliwego kodu.

Docker MCP Catalog jest przykładem infrastruktury, która może ułatwić masową adopcję MCP. Podobnie jak kontenery ustandaryzowały wdrażanie aplikacji, tak katalogi i rejestry serwerów MCP mogą ustandaryzować dystrybucję narzędzi dla agentów AI. Nie wystarczy jednak sama wygoda. Potrzebne są mechanizmy weryfikacji, aktualizacji, polityki bezpieczeństwa i przejrzystość tego, jakie uprawnienia dany serwer otrzymuje.

Warto zwrócić uwagę, że oficjalny rejestr MCP jest opisywany jako miejsce przypominające „app store” dla serwerów MCP. To dobra analogia, ale też ostrzeżenie. Sklep z integracjami może przyspieszyć rozwój ekosystemu, lecz jednocześnie tworzy nowe ryzyko supply chain. Agent AI podłączony do niezweryfikowanego serwera może stać się bramą do danych, kont, plików lub systemów firmowych.

Przykład 5: OpenAI, Codex i MCP jako warstwa narzędzi dla modeli

OpenAI wykorzystuje MCP w dokumentacji Agents SDK oraz Codex. W dokumentacji Agents SDK MCP jest opisany jako otwarty protokół standaryzujący sposób dostarczania kontekstu do LLM-ów. W dokumentacji Codex MCP służy do podłączania modeli do narzędzi i kontekstu, na przykład zewnętrznej dokumentacji, przeglądarki lub Figmy.

Ten przykład dobrze pokazuje zmianę w myśleniu o modelach AI. Sam model staje się tylko jednym z elementów większego systemu. Obok niego pojawiają się narzędzia, pamięć, polityki bezpieczeństwa, interfejs użytkownika, system uprawnień, protokoły komunikacyjne i serwery udostępniające kontekst. MCP nie zastępuje modelu, ale zwiększa jego użyteczność w konkretnych zadaniach.

Dla użytkownika końcowego może to wyglądać bardzo prosto: „popraw ten projekt”, „sprawdź dokumentację”, „porównaj wersje”, „znajdź błąd”, „przygotuj zmianę”. Pod spodem agent może jednak korzystać z kilku serwerów MCP naraz: jednego do dokumentacji, drugiego do repozytorium, trzeciego do narzędzia projektowego, czwartego do testów. To właśnie tutaj widać, dlaczego MCP jest nazywany elementem infrastruktury agentów AI.

Nie oznacza to jednak, że wszystkie aplikacje natychmiast staną się agentami. W wielu przypadkach klasyczny chatbot bez dostępu do narzędzi nadal wystarczy. MCP ma największy sens tam, gdzie AI musi pracować z aktualnymi danymi, wykonywać konkretne akcje albo działać w środowisku, w którym liczy się kontekst zadania.

Gdzie można wykorzystać serwery MCP?

Serwery MCP można wykorzystać wszędzie tam, gdzie model AI potrzebuje bezpiecznego, kontrolowanego dostępu do narzędzi lub danych. Najbardziej oczywiste zastosowania są dziś związane z programowaniem, dokumentacją techniczną, pracą z plikami, automatyzacją procesów i obsługą systemów firmowych.

W programowaniu MCP może łączyć agenta z repozytorium kodu, dokumentacją, systemem issue, narzędziami CI/CD i środowiskiem testowym. W pracy biurowej może dać dostęp do dokumentów, kalendarza, notatek, bazy wiedzy albo CRM-u. W analityce może połączyć AI z hurtownią danych, arkuszami, dashboardami i systemami raportowania. W e-commerce może wspierać zarządzanie katalogiem produktów, wyszukiwanie informacji o zamówieniach albo automatyzację obsługi klienta.

Przykładowe zastosowania serwerów MCP:

- wyszukiwanie aktualnych informacji w oficjalnej dokumentacji,

- analiza repozytorium kodu i pull requestów,

- pobieranie danych z firmowej bazy wiedzy,

- tworzenie zgłoszeń w systemie ticketowym,

- analiza logów i metryk systemowych,

- obsługa narzędzi chmurowych,

- sprawdzanie kosztów usług,

- przygotowywanie raportów z wielu źródeł,

- automatyzacja powtarzalnych operacji w narzędziach firmowych.

Najważniejsza różnica względem klasycznej automatyzacji polega na tym, że agent AI może sam dobrać narzędzie do zadania. Nie musi mieć osobnego przycisku do każdej akcji. Użytkownik opisuje cel językiem naturalnym, a agent wybiera odpowiedni serwer MCP i narzędzie. To obiecujące, ale wymaga bardzo dobrej kontroli uprawnień, bo wygoda bez zabezpieczeń szybko zamienia się w ryzyko.

Największe zalety serwerów MCP

Pierwszą zaletą serwerów MCP jest standaryzacja. Jeżeli protokół jest obsługiwany przez wiele narzędzi, łatwiej budować integracje, które nie są przywiązane do jednego dostawcy. To szczególnie ważne w świecie AI, gdzie firmy korzystają jednocześnie z wielu modeli, środowisk i platform.

Drugą zaletą jest dostęp do aktualnego kontekstu. Modele językowe mają ograniczenia: mogą nie znać najnowszych zmian, mogą mylić wersje dokumentacji, mogą generować odpowiedzi na podstawie niepełnych danych. Serwer MCP może dostarczyć konkretny, aktualny fragment informacji z zewnętrznego źródła. To nie usuwa wszystkich błędów, ale poprawia warunki, w których model podejmuje decyzję.

Trzecią zaletą jest modularność. Firma może budować lub wdrażać osobne serwery MCP dla różnych systemów: dokumentacji, repozytoriów, danych, CRM-u, chmury, analityki. Każdy serwer ma określony zakres odpowiedzialności. To zdrowsze niż jeden wielki agent z dostępem do wszystkiego.

Najważniejsze korzyści można streścić tak:

- mniej ręcznego tworzenia integracji dla każdego narzędzia AI,

- większa przenośność między klientami obsługującymi MCP,

- dostęp do aktualnych danych i dokumentacji,

- możliwość budowy agentów wykonujących realne zadania,

- lepsze oddzielenie modelu AI od warstwy dostępu do systemów,

- łatwiejsze zarządzanie narzędziami w środowiskach firmowych,

- potencjał do tworzenia katalogów i rejestrów zaufanych serwerów.

Największą zaletą strategiczną jest jednak to, że MCP może stać się warstwą infrastrukturalną dla agentów AI. Tak jak API ułatwiły rozwój aplikacji internetowych, tak protokoły agentowe mogą ułatwić rozwój aplikacji, w których AI nie tylko odpowiada, ale też działa.

Największe ryzyka i ograniczenia serwerów MCP

Największe ryzyko MCP wynika z tego samego powodu, dla którego technologia jest ciekawa: agent AI dostaje dostęp do narzędzi. Jeżeli model może czytać pliki, wykonywać komendy, korzystać z API, pobierać dane lub zmieniać konfigurację, błędna decyzja albo atak może mieć realne skutki.

Oficjalne materiały bezpieczeństwa MCP wskazują na ryzyka związane z autoryzacją, prompt injection, nieuprawnionym dostępem, zaufaniem do narzędzi i projektowaniem bezpiecznych przepływów. Dokumentacja bezpieczeństwa podkreśla, że jej odbiorcami są m.in. twórcy serwerów MCP, operatorzy serwerów i specjaliści oceniający systemy oparte na MCP.

Jednym z najbardziej znanych zagrożeń jest prompt injection. Chodzi o sytuację, w której zewnętrzna treść — na przykład dokument, strona internetowa, issue albo plik — zawiera ukryte instrukcje próbujące wpłynąć na zachowanie modelu. Microsoft opisywał ten problem w kontekście MCP i wskazywał sposoby ograniczania ryzyka ataków pośredniej prompt injection.

Drugim ryzykiem jest nadmierny zakres uprawnień. Serwer MCP powinien mieć tylko takie prawa, jakie są potrzebne do wykonania zadania. Agent, który może odczytywać wszystkie pliki, wykonywać komendy systemowe i modyfikować repozytorium bez potwierdzenia, jest wygodny, ale niebezpieczny. W firmach konieczne są zasady least privilege, audyt, logowanie działań i human-in-the-loop przy operacjach wrażliwych.

Trzecim ograniczeniem jest dojrzałość ekosystemu. MCP rozwija się szybko, ale to nadal stosunkowo młody standard. Aktualna specyfikacja, narzędzia, katalogi, autoryzacja i dobre praktyki bezpieczeństwa dojrzewają wraz z adopcją. To oznacza, że firmy powinny testować MCP świadomie, a nie traktować go jako gotowego rozwiązania na każdy problem.

Bezpieczeństwo MCP: gdzie trzeba uważać najbardziej?

Wdrożenie serwerów MCP wymaga myślenia podobnego do wdrażania API, narzędzi RPA i dostępu administracyjnego — tylko z dodatkową warstwą nieprzewidywalności modelu językowego. Agent AI może źle zinterpretować polecenie, źle dobrać narzędzie albo zostać zmanipulowany przez dane wejściowe.

Najbardziej wrażliwe są serwery, które mają dostęp do systemu plików, repozytoriów kodu, sekretów, baz danych, narzędzi administracyjnych, płatności, systemów produkcyjnych i kont użytkowników. W takich przypadkach nie wystarczy „podłączyć MCP”. Potrzebne są ograniczenia środowiska, jawne potwierdzenia działań, izolacja procesów, kontrola tokenów i zasady cofania zmian.

Specyfikacja autoryzacji MCP wskazuje na wymagania związane z OAuth 2.0 Protected Resource Metadata dla serwerów MCP. To ważny kierunek, bo zdalne serwery MCP muszą być traktowane jak chronione zasoby, a nie proste dodatki do chatbota.

Dobre praktyki powinny obejmować co najmniej:

- osobne konta i tokeny dla agentów,

- minimalny zakres uprawnień,

- blokowanie operacji wysokiego ryzyka bez potwierdzenia użytkownika,

- logowanie wywołań narzędzi,

- weryfikację źródła serwerów MCP,

- aktualizowanie SDK i zależności,

- testy prompt injection,

- separację środowiska testowego od produkcyjnego,

- jasne komunikaty dla użytkownika, kiedy agent wykonuje akcję.

Najważniejsza zasada brzmi: MCP nie powinien być traktowany jako skrót omijający bezpieczeństwo. Jeżeli agent dostaje dostęp do narzędzia, trzeba założyć, że pewnego dnia użyje go w sposób niepożądany — przez błąd, nieprecyzyjne polecenie albo atak.

Serwery MCP a inne protokoły agentów AI

MCP jest ważny, ale nie jest jedynym protokołem w ekosystemie agentów AI. Google w swoim przewodniku pokazuje kilka protokołów, które odpowiadają za różne warstwy działania agentów. MCP łączy agenta z narzędziami i danymi. A2A, czyli Agent2Agent, odpowiada za komunikację między agentami. UCP dotyczy scenariuszy handlowych, AP2 płatności, a A2UI i AG-UI interfejsu oraz strumieniowania doświadczeń użytkownika.

To rozróżnienie jest ważne, bo w dyskusji o AI łatwo wrzucić wszystko do jednego worka. MCP nie rozwiązuje wszystkich problemów agentów. Nie jest protokołem płatności, nie jest systemem tożsamości, nie jest pełnym frameworkiem do zarządzania wieloma agentami i nie jest gwarancją bezpieczeństwa. Jest warstwą dostępu do narzędzi i kontekstu.

W praktyce przyszłe systemy agentowe mogą używać kilku protokołów naraz. Agent obsługi klienta może korzystać z MCP, aby pobrać dane z CRM-u, z A2A, aby przekazać sprawę innemu agentowi specjalistycznemu, oraz z protokołów płatności lub handlu, jeżeli ma obsługiwać transakcję. To dopiero pokazuje prawdziwą skalę zmiany: agenci AI nie będą jedną aplikacją, lecz siecią usług, narzędzi i standardów.

Dla firm oznacza to jedno: nie warto wdrażać protokołów dla samego trendu. Warto zrozumieć, jaki problem rozwiązuje każdy z nich. MCP jest dobrym pierwszym krokiem tam, gdzie AI ma dostać dostęp do danych i narzędzi. Inne protokoły mają sens dopiero wtedy, gdy pojawiają się bardziej złożone scenariusze współpracy agentów, interfejsów lub transakcji.

Co serwery MCP oznaczają dla zwykłych użytkowników?

Dla zwykłego użytkownika serwery MCP mogą być niewidoczne. I właśnie o to chodzi. Użytkownik nie musi wiedzieć, jaki protokół działa pod spodem. Ma po prostu zobaczyć, że asystent AI potrafi zrobić więcej: znaleźć dokument, sprawdzić status, porównać dane, przygotować odpowiedź na podstawie aktualnych źródeł albo wykonać prostą akcję w aplikacji.

Przykład: zamiast pytać „jak znaleźć fakturę z marca?”, użytkownik może poprosić: „znajdź fakturę za hosting z marca i podsumuj koszty”. Agent podłączony do odpowiednich serwerów MCP może przeszukać pocztę, dokumenty lub system księgowy, a potem przygotować podsumowanie. Oczywiście tylko wtedy, gdy ma uprawnienia i działa w bezpiecznym środowisku.

Inny przykład: użytkownik korzysta z aplikacji do zarządzania projektami i pyta: „co blokuje wdrożenie tej funkcji?”. Agent może sprawdzić issue, komentarze, dokumentację i status pull requestów. Bez MCP lub podobnej warstwy integracyjnej model musiałby bazować na tym, co użytkownik ręcznie wklei do rozmowy.

Największą zmianą dla użytkownika będzie więc przejście od rozmowy z AI do pracy z AI. Chatbot odpowiada. Agent wspierany przez serwery MCP może działać na danych i narzędziach. Różnica jest ogromna, ale powinna być wdrażana stopniowo. Użytkownik musi rozumieć, kiedy AI tylko sugeruje odpowiedź, a kiedy faktycznie wykonuje operację w jego imieniu.

Co serwery MCP oznaczają dla firm?

Dla firm serwery MCP mogą stać się sposobem na uporządkowanie integracji AI. Zamiast pozwalać pracownikom na przypadkowe podłączanie narzędzi do różnych chatbotów, organizacja może budować katalog zatwierdzonych serwerów MCP, kontrolować uprawnienia i monitorować użycie.

Największy potencjał widać w działach IT, software development, customer support, sprzedaży, analityce, finansach i operacjach. Agent AI może wspierać pracownika w odnajdywaniu informacji, przygotowywaniu raportów, analizowaniu logów, tworzeniu zgłoszeń, pracy z dokumentacją lub porównywaniu danych z wielu systemów. MCP nie zastępuje procesów firmowych, ale może stać się warstwą, przez którą AI uzyskuje kontrolowany dostęp do tych procesów.

Jednocześnie MCP wymusza nowe pytania organizacyjne. Kto zatwierdza serwery? Kto sprawdza ich kod? Kto odpowiada za uprawnienia? Jak długo przechowywane są logi? Czy agent może modyfikować dane, czy tylko je czytać? Kiedy wymagana jest zgoda człowieka? Jak odróżnić serwer oficjalny od społecznościowego? Jak wycofać dostęp, gdy pracownik odchodzi z firmy?

Firmy, które potraktują MCP wyłącznie jako modny dodatek do AI, mogą szybko stworzyć nowe ryzyko bezpieczeństwa. Firmy, które potraktują MCP jako warstwę infrastruktury, mogą zyskać bardziej kontrolowany sposób wdrażania agentów AI w realnych procesach.

Które przykłady najlepiej pokazują przyszłość agentów AI?

Najlepsze przykłady serwerów MCP to nie te, które robią największe wrażenie w demonstracji, lecz te, które rozwiązują konkretny problem dostępu do kontekstu. Microsoft Learn MCP Server pokazuje przyszłość agentów opartych na aktualnej dokumentacji. GitHub i serwery dla narzędzi deweloperskich pokazują przyszłość agentów programistycznych. Cloudflare pokazuje kierunek zdalnych, zarządzanych serwerów dla firm. Docker MCP Catalog pokazuje problem dystrybucji i zaufania do serwerów. OpenAI i Codex pokazują MCP jako warstwę narzędzi dla modeli używanych w codziennej pracy technicznej.

Wspólny mianownik jest prosty: agent AI nie może działać dobrze bez kontekstu. Im bardziej konkretne zadanie, tym bardziej potrzebne są aktualne dane, narzędzia i uprawnienia. MCP dostarcza standardowy sposób, aby ten kontekst podłączyć.

Najbardziej przyszłościowe są więc nie pojedyncze „efektowne” serwery, ale całe środowiska, w których agent ma dostęp do kilku kontrolowanych źródeł naraz. Przykładowo agent deweloperski może korzystać z dokumentacji, repozytorium, systemu issue i narzędzia testowego. Agent finansowy może korzystać z dokumentów, polityk firmowych, systemu faktur i narzędzia raportowego. Agent obsługi klienta może korzystać z CRM-u, bazy wiedzy, historii zgłoszeń i systemu zamówień.

To jest prawdziwa przyszłość agentów AI: nie „jeden bot do wszystkiego”, ale system agentowy działający na sprawdzonych narzędziach, ograniczonych uprawnieniach i aktualnych danych.

Co może wydarzyć się dalej?

Fakty są takie: MCP ma oficjalną specyfikację, rosnącą adopcję w narzędziach deweloperskich i chmurowych, wsparcie dużych firm oraz miejsce w Agentic AI Foundation pod Linux Foundation. To oznacza, że standard nie jest już wyłącznie eksperymentem jednej firmy.

Prawdopodobny kierunek rozwoju to większa liczba zdalnych serwerów MCP, lepsze katalogi zaufanych integracji, bardziej dojrzała autoryzacja, silniejsze mechanizmy bezpieczeństwa i większa integracja z narzędziami pracy. Serwery MCP mogą stać się dla agentów AI tym, czym wtyczki, API i marketplace’y były dla wcześniejszych generacji aplikacji.

Trzeba jednak ostrożnie oddzielić fakty od przewidywań. Nie wiemy jeszcze, czy MCP pozostanie dominującym standardem na wiele lat. Nie wiemy, jak szybko firmy będą wdrażać agentów AI w procesach produkcyjnych. Nie wiemy też, czy obecne mechanizmy bezpieczeństwa okażą się wystarczające przy masowej adopcji. Wiadomo natomiast, że potrzeba standaryzacji jest realna, bo bez niej agenci AI będą tonąć w chaotycznych, trudnych do utrzymania integracjach.

Najbardziej realistyczny scenariusz na najbliższy czas to rozwój MCP przede wszystkim w środowiskach technicznych: IDE, dokumentacja, repozytoria, narzędzia chmurowe, analityka i automatyzacja pracy. Dopiero później standard może szerzej przenikać do aplikacji konsumenckich, biurowych i branżowych.

Podsumowanie

Serwery MCP są jednym z najważniejszych elementów infrastruktury, która może przesunąć AI od rozmowy do działania. Ich zadanie jest konkretne: dać agentom AI ustandaryzowany dostęp do danych, narzędzi i kontekstu. Bez tego agent pozostaje głównie interfejsem tekstowym. Z tym dostępem może zacząć wykonywać realne zadania.

Najlepsze przykłady — Microsoft Learn MCP Server, integracje GitHub, Cloudflare, Docker MCP Catalog, OpenAI Codex i serwery dla narzędzi deweloperskich — pokazują, że MCP nie jest tylko ciekawostką dla programistów. To kandydat na wspólną warstwę integracji dla agentów AI.

Nie jest to jednak technologia bez ryzyka. Serwer MCP może dać agentowi dostęp do bardzo wrażliwych danych i operacji. Dlatego przyszłość MCP będzie zależeć nie tylko od liczby integracji, ale też od bezpieczeństwa, zarządzania uprawnieniami, jakości katalogów i zdolności firm do wdrażania agentów z realną kontrolą.

Najkrócej: MCP może stać się dla agentów AI tym, czym API było dla aplikacji internetowych — ale tylko wtedy, gdy wygoda integracji pójdzie w parze z bezpieczeństwem.

FAQ – serwery MCP

Co to są serwery MCP?

Jak działają serwery MCP?

Czy serwery MCP są bezpieczne?

Do czego służą serwery MCP w AI?

Czy warto interesować się MCP?

Źródła:

- Google Developers Blog – Developer’s Guide to AI Agent Protocols

- Model Context Protocol – oficjalne wprowadzenie do MCP

- Model Context Protocol – oficjalna specyfikacja MCP

- Microsoft Learn MCP Server – oficjalna dokumentacja

- Linux Foundation – Agentic AI Foundation i MCP

Dziękujemy za przeczytanie artykułu na Techoteka.pl.

Publikujemy codziennie informacje o sztucznej inteligencji, nowych technologiach, IT oraz rozwoju agentów AI.

Obserwuj nas na Facebooku, aby nie przegapić kolejnych artykułów.