Sztuczna inteligencja (AI) w ciągu zaledwie kilku lat przeszła drogę od eksperymentalnych algorytmów rozwijanych w laboratoriach technologicznych do jednej z najważniejszych technologii współczesnego świata. Dziś AI wpływa na niemal każdy obszar życia – od wyszukiwania informacji i smartfonów po medycynę, przemysł, naukę i bezpieczeństwo państw.

Rozwój ogromnych modeli językowych LLM sprawił, że komputery potrafią już pisać teksty, analizować dane, programować, tworzyć obrazy, generować wideo, a nawet prowadzić naturalne rozmowy z użytkownikami. Narzędzia takie jak ChatGPT, Gemini, Claude czy Copilot pokazują, że generatywna AI zaczyna zmieniać sposób pracy milionów ludzi.

Jednocześnie gwałtowny rozwój sztucznej inteligencji rodzi wiele fundamentalnych pytań. Jak właściwie działa AI? Kto kontroluje rozwój tej technologii? Czy sztuczna inteligencja zastąpi ludzi w pracy i czy w przyszłości może osiągnąć poziom ludzkiej inteligencji?

W tym przewodniku wyjaśniamy wszystko – od podstaw działania sztucznej inteligencji, przez modele językowe LLM i generatywną AI, aż po globalną rywalizację technologiczną między Stanami Zjednoczonymi, Chinami i Europą.

Najważniejsze wnioski:

-

Sztuczna inteligencja (AI) stała się jedną z najważniejszych technologii XXI wieku i wpływa na gospodarkę, naukę oraz codzienne życie.

-

Przełomem w rozwoju AI były ogromne modele językowe LLM, które potrafią analizować i generować tekst, obrazy, kod oraz inne treści.

-

Generatywna AI zmienia sposób pracy w wielu branżach – od marketingu i programowania po medycynę i analizę danych.

-

Największe firmy technologiczne świata inwestują miliardy dolarów w rozwój sztucznej inteligencji, traktując ją jako strategiczną technologię przyszłości.

-

Rozwój AI rodzi również poważne wyzwania, takie jak deepfake, dezinformacja, zmiany na rynku pracy czy kwestie etyczne.

Czym jest sztuczna inteligencja (AI)

Definicja sztuczna inteligencja (AI) w skrócie

Sztuczna inteligencja (AI) to dziedzina informatyki zajmująca się tworzeniem systemów komputerowych zdolnych do analizowania danych, uczenia się na podstawie doświadczeń oraz podejmowania decyzji w sposób przypominający ludzką inteligencję.

Sztuczna inteligencja (AI) to zbiorcze określenie technologii, które pozwalają komputerom wykonywać zadania wymagające wcześniej ludzkiej inteligencji. Należą do nich między innymi rozumienie języka naturalnego, analiza obrazów, podejmowanie decyzji, rozwiązywanie problemów czy generowanie treści. W przeciwieństwie do klasycznych programów komputerowych, które działają według z góry zapisanych instrukcji, AI uczy się na podstawie danych, identyfikując wzorce i zależności w ogromnych zbiorach informacji.

Współczesna sztuczna inteligencja opiera się przede wszystkim na technikach uczenia maszynowego i głębokiego uczenia (deep learning), w których algorytmy analizują miliardy przykładów i stopniowo poprawiają swoje działanie. Dzięki temu systemy AI potrafią dziś tłumaczyć teksty, diagnozować choroby na podstawie obrazów medycznych, rozpoznawać twarze czy prowadzić rozmowy z użytkownikiem.

Szczególną rolę w ostatnich latach odegrały modele językowe LLM, czyli ogromne systemy trenowane na ogromnych zbiorach tekstów z internetu, książek i artykułów naukowych. To właśnie dzięki nim powstała generatywna AI, zdolna do tworzenia nowych treści: tekstów, kodu, obrazów, muzyki czy nawet wideo. Narzędzia takie jak ChatGPT, Gemini czy Claude pokazują, że AI przestaje być wyłącznie narzędziem analitycznym, a staje się partnerem w pracy intelektualnej.

Rozwój sztucznej inteligencji oznacza również zmianę w sposobie korzystania z technologii. Zamiast wpisywać komendy czy przeszukiwać menu aplikacji, użytkownicy coraz częściej po prostu rozmawiają z systemem AI, który interpretuje polecenia i samodzielnie wykonuje zadania.

„Sztuczna inteligencja to jedna z najważniejszych rzeczy, nad którymi pracuje ludzkość. Jest bardziej głęboka niż elektryczność czy ogień”.

— Sundar Pichai, CEO Google

Sztuczna inteligencja (AI) a automatyzacja – kluczowa różnica

W debacie o nowych technologiach często pojawia się pytanie, czym właściwie różni się sztuczna inteligencja od tradycyjnej automatyzacji. Choć oba pojęcia bywają używane zamiennie, w rzeczywistości opisują zupełnie różne podejścia do programowania.

Automatyzacja polega na wykonywaniu powtarzalnych zadań według ściśle określonych reguł. Klasyczny program komputerowy działa zgodnie z logiką „jeśli – to”. Jeżeli spełniony jest określony warunek, system wykonuje konkretną instrukcję. Tego typu rozwiązania są niezwykle skuteczne w stabilnych środowiskach, gdzie wszystkie scenariusze można przewidzieć z góry.

Sztuczna inteligencja działa inaczej. Zamiast polegać wyłącznie na zestawie reguł zapisanych przez programistę, system AI uczy się na podstawie danych. Oznacza to, że potrafi radzić sobie z sytuacjami, których wcześniej nie zaprogramowano wprost.

Dobrym przykładem jest rozpoznawanie obrazów. W tradycyjnym oprogramowaniu należałoby zaprogramować setki reguł opisujących każdy możliwy wariant obrazu. W przypadku AI wystarczy pokazać algorytmowi miliony zdjęć, aby nauczył się samodzielnie rozpoznawać wzorce.

Dlatego właśnie generatywna AI i modele językowe LLM są tak przełomowe. Systemy te nie tylko wykonują polecenia, ale potrafią analizować kontekst, interpretować znaczenie wypowiedzi i generować nowe odpowiedzi w oparciu o wcześniej przyswojoną wiedzę.

Sztuczna inteligencja (AI) a tradycyjne oprogramowanie

Klasyczne oprogramowanie komputerowe jest deterministyczne – oznacza to, że dla danego zestawu danych wejściowych zawsze generuje dokładnie ten sam wynik. Programista musi przewidzieć wszystkie scenariusze działania aplikacji i zapisać je w kodzie.

W przypadku sztucznej inteligencji sytuacja wygląda inaczej. System AI nie otrzymuje jedynie zestawu instrukcji, ale także ogromne ilości danych treningowych, które pozwalają mu nauczyć się określonych zależności. Dzięki temu algorytmy mogą podejmować decyzje nawet w sytuacjach, których wcześniej nie zaprogramowano.

Najbardziej widoczne jest to w przypadku modeli językowych LLM. Zamiast zestawu reguł gramatycznych czy słownika, modele te analizują miliardy fragmentów tekstu i uczą się statystycznych zależności między słowami. W efekcie potrafią generować spójne wypowiedzi, odpowiadać na pytania czy pisać artykuły.

To właśnie ta zdolność do generowania nowych treści sprawiła, że generatywna AI stała się jednym z najważniejszych trendów technologicznych XXI wieku. W wielu zastosowaniach AI zaczyna zastępować tradycyjne oprogramowanie, które nie jest w stanie analizować tak złożonych danych jak język naturalny czy obrazy.

Krótka historia sztucznej inteligencji

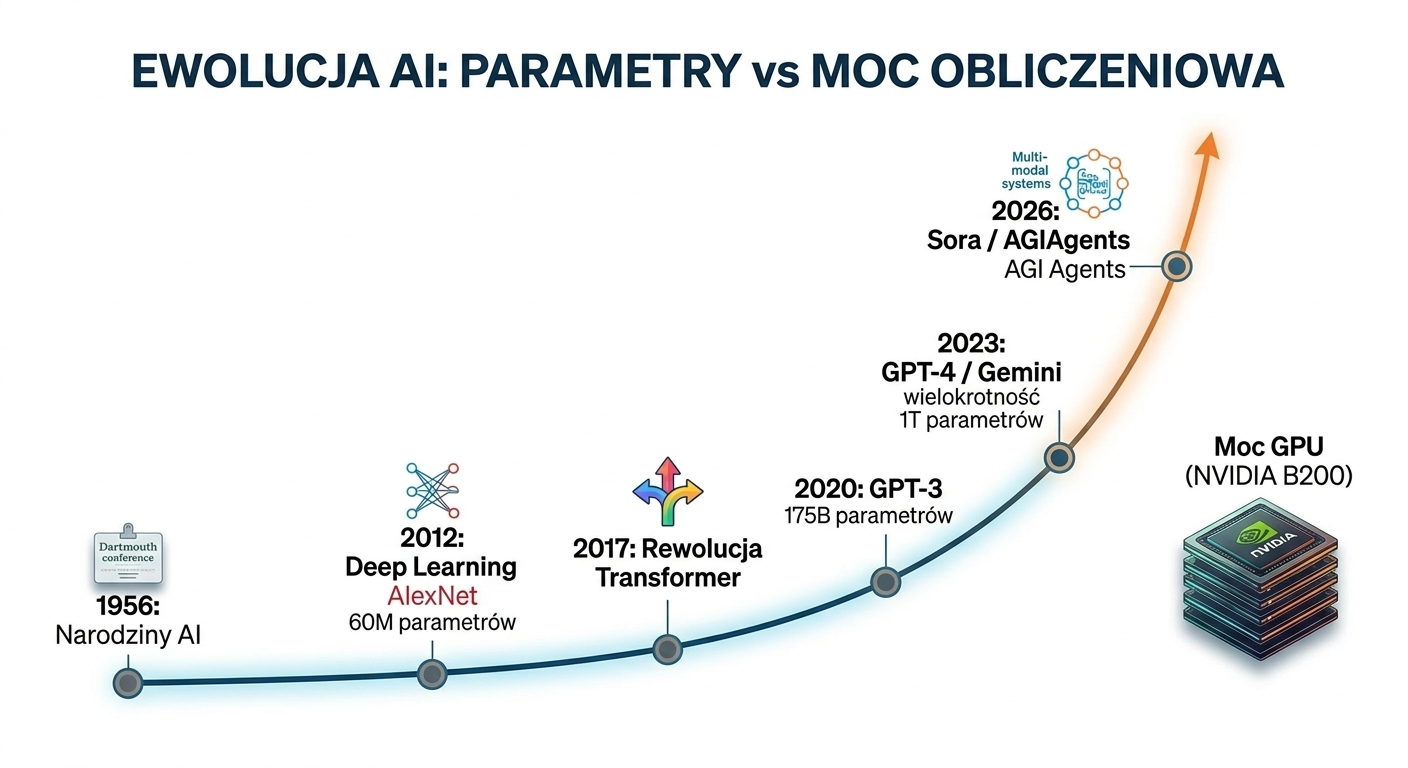

1956 – narodziny idei AI

Historia sztucznej inteligencji zaczyna się w 1956 roku podczas konferencji Dartmouth College w Stanach Zjednoczonych. To właśnie wtedy grupa naukowców po raz pierwszy użyła terminu Artificial Intelligence do opisania dziedziny badań nad maszynami zdolnymi do symulowania ludzkiego myślenia.

Uczestnicy konferencji wierzyli, że stworzenie inteligentnych maszyn jest jedynie kwestią kilku dekad. Zakładali, że komputery wkrótce będą potrafiły tłumaczyć języki, rozwiązywać problemy matematyczne czy prowadzić rozmowy z ludźmi.

Rzeczywistość okazała się bardziej skomplikowana. W kolejnych latach rozwój AI wielokrotnie spowalniał z powodu ograniczeń technologicznych i braku wystarczającej mocy obliczeniowej. Okresy stagnacji nazwano nawet „zimami sztucznej inteligencji”.

Lata 80 – era systemów eksperckich

W latach 80. nastąpił pierwszy poważny boom technologiczny związany z AI. W tym czasie popularność zdobyły tzw. systemy eksperckie – programy komputerowe zaprojektowane do rozwiązywania konkretnych problemów w wyspecjalizowanych dziedzinach.

Systemy te wykorzystywały rozbudowane bazy wiedzy oraz zestawy reguł logicznych, które pozwalały im podejmować decyzje podobne do tych, jakie podejmowałby ekspert w danej dziedzinie. Przykładem mogły być systemy wspomagające diagnostykę medyczną czy analizę danych finansowych.

Choć rozwiązania te nie były jeszcze prawdziwą sztuczną inteligencją, pokazały ogromny potencjał komputerów w analizowaniu złożonych problemów. Jednocześnie ujawniły ograniczenia podejścia opartego wyłącznie na regułach zapisanych przez programistów.

2012 – przełom deep learning

Prawdziwa rewolucja w rozwoju AI nastąpiła dopiero w drugiej dekadzie XXI wieku. W 2012 roku zespół badaczy zaprezentował model sieci neuronowej, który znacząco poprawił wyniki w rozpoznawaniu obrazów. Był to moment przełomowy dla technologii deep learning.

Sieci neuronowe zaczęły być trenowane na ogromnych zbiorach danych przy użyciu potężnych procesorów graficznych (GPU). Dzięki temu systemy AI osiągnęły poziom dokładności, który w wielu zadaniach dorównywał lub nawet przewyższał możliwości człowieka.

W kolejnych latach deep learning znalazł zastosowanie w rozpoznawaniu mowy, tłumaczeniach automatycznych, analizie obrazów medycznych czy systemach rekomendacji.

2022 – eksplozja generatywnej AI

Rok 2022 okazał się jednym z najważniejszych momentów w historii technologii. Wtedy właśnie pojawiły się pierwsze szeroko dostępne systemy generatywnej AI, oparte na ogromnych modelach językowych LLM.

Narzędzia takie jak ChatGPT pokazały, że AI potrafi nie tylko analizować dane, ale również tworzyć nowe treści – teksty, kod, obrazy czy wideo. W ciągu kilku miesięcy generatywna sztuczna inteligencja stała się jednym z najważniejszych tematów w świecie technologii, biznesu i polityki.

Rozwój LLM zmienił również sposób korzystania z komputerów. Interfejs oparty na rozmowie zaczyna zastępować tradycyjne aplikacje i wyszukiwarki.

Może Cię zainteresować: Historia sztucznej inteligencji (AI) – przełomowe osiągnięcia, które zmieniły technologię

Rodzaje sztucznej inteligencji

Narrow AI (ANI)

Obecnie niemal wszystkie systemy AI należą do kategorii tzw. Narrow AI, czyli sztucznej inteligencji wyspecjalizowanej w konkretnym zadaniu. Oznacza to, że system może być niezwykle skuteczny w jednej dziedzinie, ale nie potrafi przenieść swojej wiedzy na inne obszary.

Przykładem Narrow AI są modele językowe LLM, które potrafią analizować i generować tekst, ale nie posiadają uniwersalnej wiedzy o świecie w sposób zbliżony do człowieka.

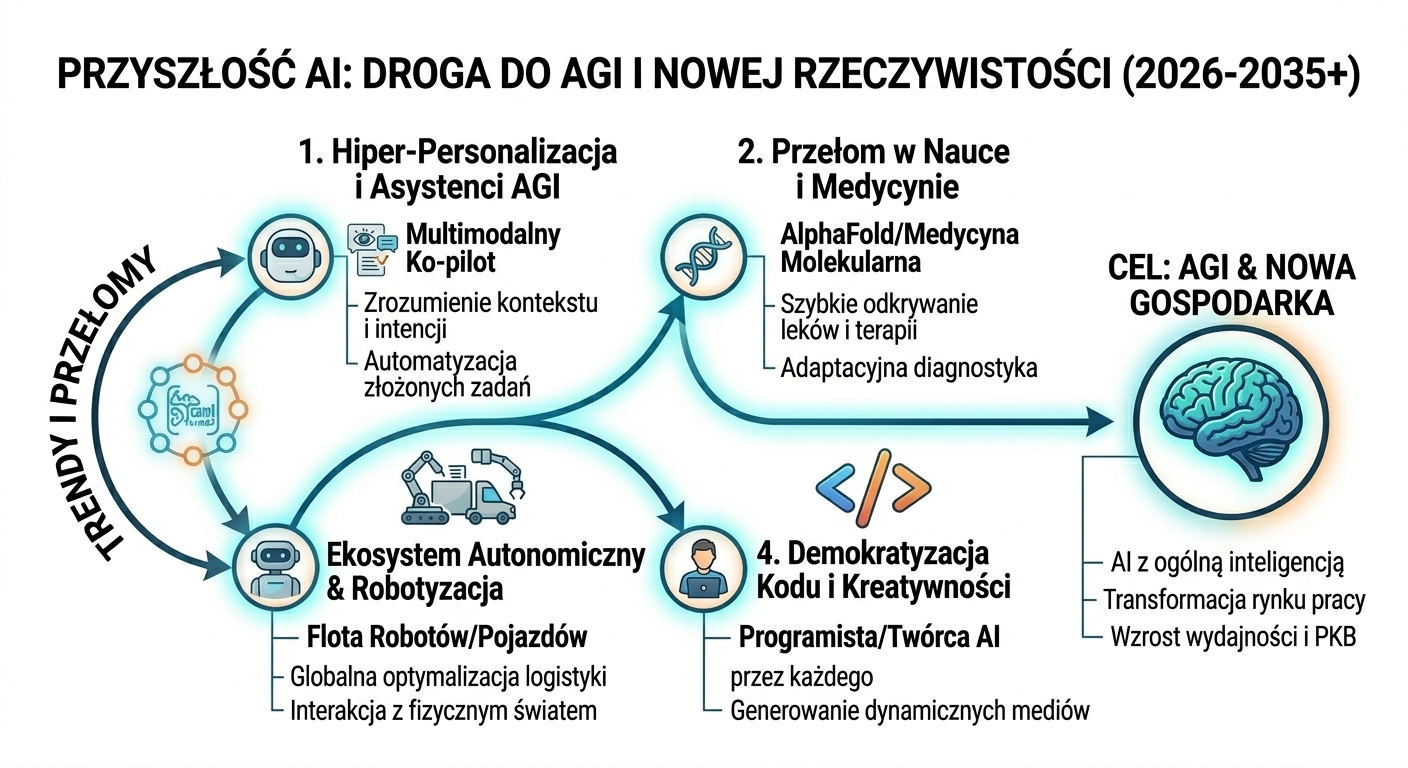

Artificial General Intelligence (AGI)

AGI to hipotetyczny poziom rozwoju AI, w którym system osiąga zdolności poznawcze porównywalne z ludzkimi. Oznaczałoby to, że maszyna potrafi rozumieć, uczyć się i rozwiązywać problemy w wielu różnych dziedzinach – tak jak człowiek.

Wielu naukowców uważa, że osiągnięcie AGI może być jednym z najważniejszych wydarzeń technologicznych w historii cywilizacji.

Artificial Superintelligence (ASI)

Jeszcze dalej idzie koncepcja Artificial Superintelligence, czyli systemu AI, który przewyższa ludzką inteligencję we wszystkich obszarach – od nauki i technologii po kreatywność i strategię.

Choć ASI pozostaje na razie w sferze spekulacji, część badaczy uważa, że szybki rozwój generatywnej AI i modeli językowych LLM może w przyszłości doprowadzić do powstania systemów znacznie potężniejszych niż obecne technologie.

Jak działa sztuczna inteligencja (AI)

Rozwój sztucznej inteligencji w ostatnich latach sprawił, że technologia ta przestała być abstrakcyjną koncepcją z laboratoriów badawczych. Systemy AI są dziś wykorzystywane w wyszukiwarkach internetowych, medycynie, finansach, autonomicznych pojazdach czy aplikacjach do generowania tekstów i obrazów. Aby zrozumieć skalę tej rewolucji, warto przyjrzeć się temu, jak właściwie działa sztuczna inteligencja.

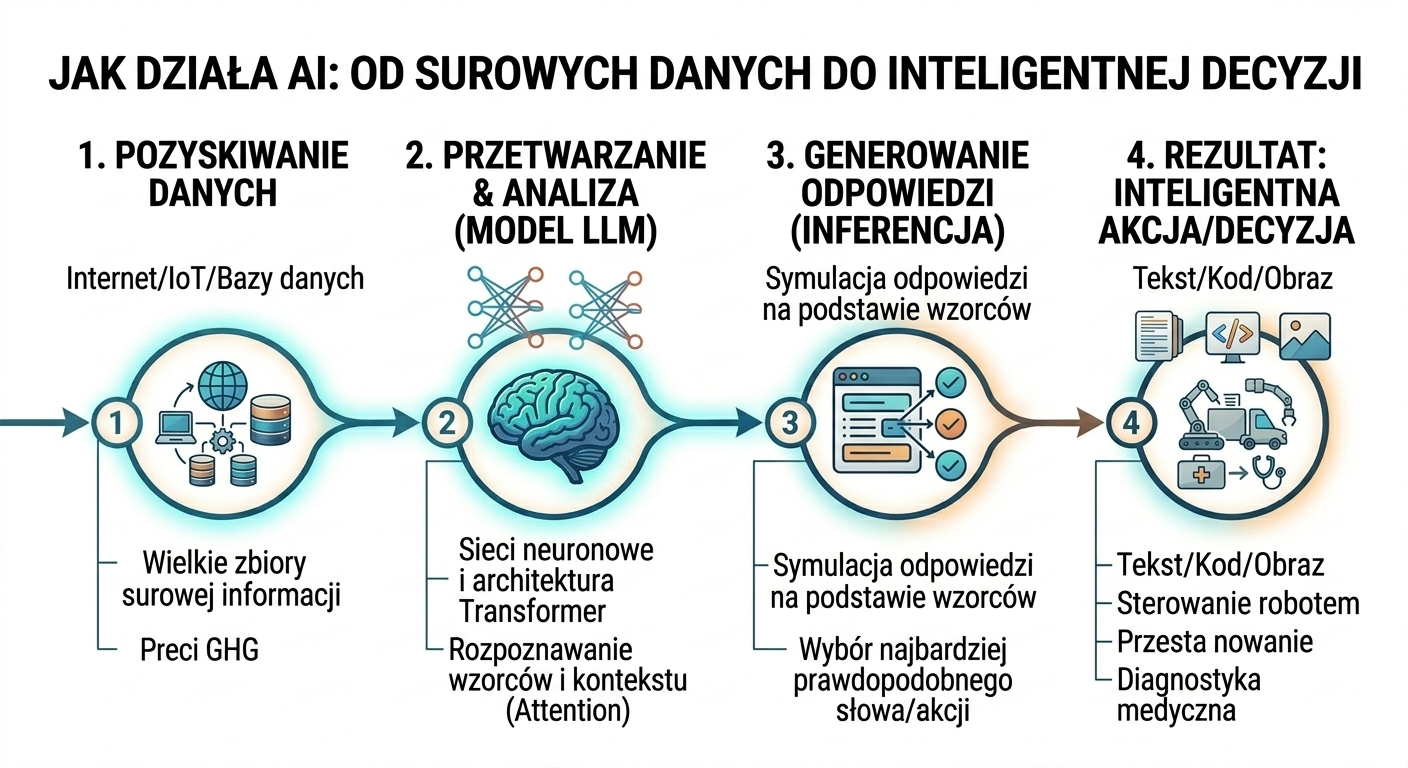

Podstawą działania współczesnej AI są trzy kluczowe elementy: ogromne zbiory danych, zaawansowane algorytmy uczenia maszynowego oraz potężna infrastruktura obliczeniowa. W przeciwieństwie do tradycyjnego oprogramowania komputerowego, które wykonuje precyzyjnie zapisane instrukcje, sztuczna inteligencja uczy się na podstawie przykładów. Algorytmy analizują dane, identyfikują wzorce i stopniowo poprawiają swoje działanie.

W praktyce oznacza to, że system AI może nauczyć się rozpoznawania obrazów, analizowania języka naturalnego czy przewidywania zdarzeń bez konieczności ręcznego programowania każdej reguły. Współczesne technologie, takie jak modele językowe LLM czy generatywna AI, są efektem wieloletnich badań nad uczeniem maszynowym, sieciami neuronowymi i deep learningiem.

Algorytmy uczenia maszynowego w sztucznej inteligencji

Jednym z fundamentów współczesnej AI jest uczenie maszynowe (machine learning). To dziedzina informatyki, w której algorytmy komputerowe uczą się na podstawie danych zamiast wykonywać wyłącznie wcześniej zapisane instrukcje.

Uczenie maszynowe pozwala systemom AI identyfikować wzorce w danych, przewidywać wyniki i podejmować decyzje w sposób coraz bardziej zbliżony do ludzkiego rozumowania. W praktyce algorytm analizuje tysiące lub miliony przykładów, a następnie wykorzystuje zdobyte doświadczenie do rozwiązywania nowych problemów.

Istnieje kilka podstawowych metod uczenia maszynowego, które stanowią fundament rozwoju sztucznej inteligencji.

Supervised learning

W modelu supervised learning algorytm AI uczy się na podstawie oznaczonych danych. Oznacza to, że każdy przykład w zbiorze treningowym zawiera zarówno dane wejściowe, jak i poprawną odpowiedź.

Na przykład system rozpoznawania obrazów może zostać wytrenowany na milionach zdjęć podpisanych jako „kot”, „pies” lub „samochód”. Analizując te dane, sztuczna inteligencja uczy się rozpoznawać charakterystyczne cechy obiektów i z czasem potrafi klasyfikować nowe obrazy.

Unsupervised learning

W przypadku unsupervised learning algorytm AI nie otrzymuje gotowych odpowiedzi. Jego zadaniem jest samodzielne odnalezienie struktury w danych.

Technika ta jest często wykorzystywana w analizie dużych zbiorów danych, gdzie system AI może identyfikować ukryte wzorce, segmentować klientów w marketingu czy wykrywać nietypowe zachowania w systemach bezpieczeństwa.

Reinforcement learning

Trzecim ważnym podejściem jest reinforcement learning, czyli uczenie przez wzmocnienie. W tym modelu system AI podejmuje decyzje w określonym środowisku i otrzymuje nagrody lub kary w zależności od skutków swoich działań.

Metoda ta była wykorzystywana między innymi w systemach takich jak AlphaGo, które nauczyły się pokonywać najlepszych graczy świata w strategiczne gry planszowe. Reinforcement learning znajduje również zastosowanie w robotyce, autonomicznych pojazdach oraz systemach optymalizacji procesów.

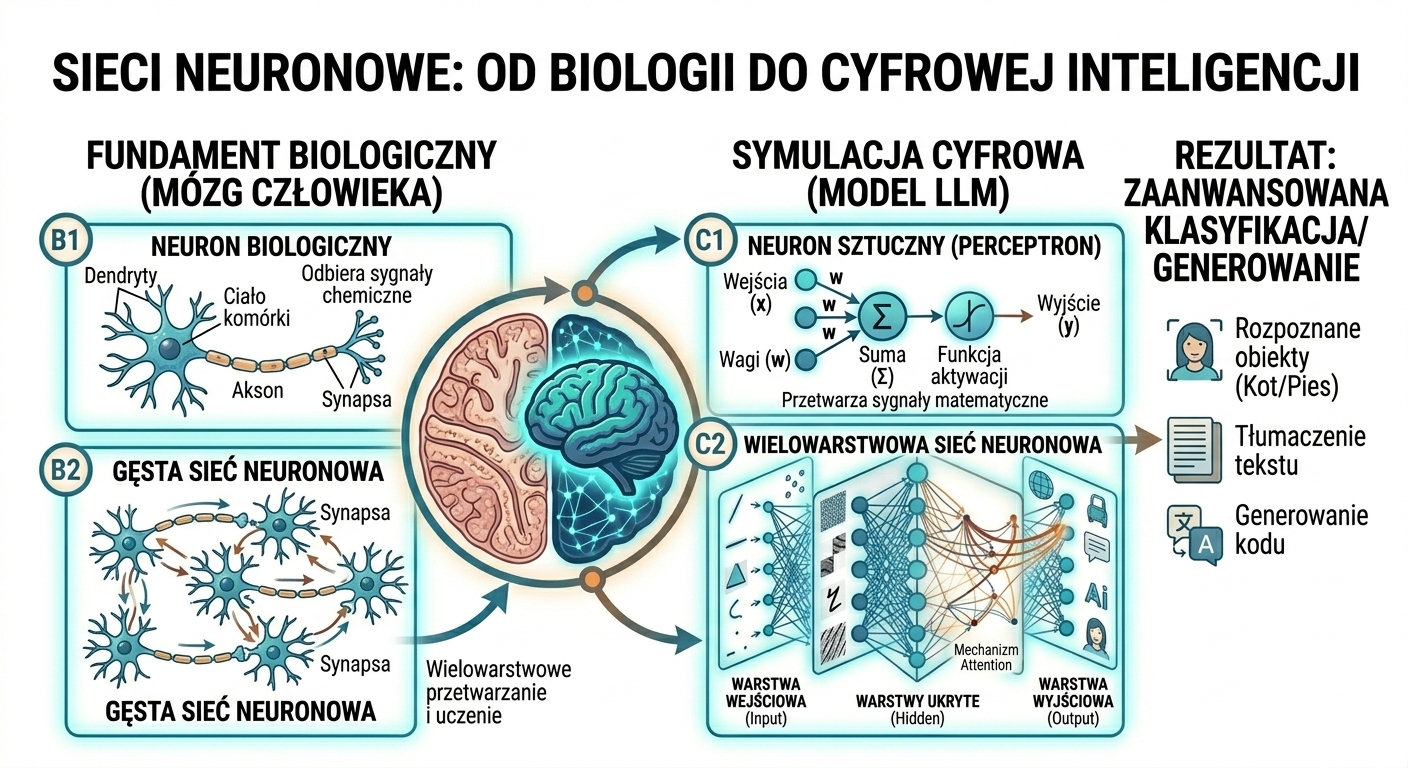

Sieci neuronowe – fundament współczesnej AI

Kluczową technologią stojącą za nowoczesną sztuczną inteligencją są sieci neuronowe. Inspiracją dla ich konstrukcji była struktura ludzkiego mózgu, w którym miliardy neuronów przetwarzają informacje poprzez skomplikowaną sieć połączeń.

Sieć neuronowa w systemach AI składa się z wielu prostych jednostek obliczeniowych zwanych neuronami sztucznymi. Każdy neuron przetwarza dane wejściowe i przekazuje wynik do kolejnych elementów sieci.

Czym są neurony sztuczne

Neuron sztuczny jest matematycznym modelem, który przyjmuje dane wejściowe, przetwarza je przy użyciu określonych wag i funkcji aktywacji, a następnie generuje wynik.

Podczas trenowania modelu AI wartości wag są stopniowo modyfikowane, aby sieć neuronowa mogła coraz dokładniej przewidywać poprawne wyniki.

Warstwy neuronowe

Sieci neuronowe składają się z kilku rodzajów warstw:

-

warstwy wejściowej, która przyjmuje dane

-

warstw ukrytych, w których zachodzi analiza danych

-

warstwy wyjściowej, generującej końcową odpowiedź

Im więcej warstw ukrytych posiada sieć, tym bardziej złożone zależności może analizować sztuczna inteligencja.

Proces trenowania modelu AI

Trenowanie modelu polega na wielokrotnym analizowaniu danych treningowych i korygowaniu parametrów sieci neuronowej. Proces ten jest obliczeniowo bardzo kosztowny i często wymaga wykorzystania specjalistycznych procesorów graficznych oraz ogromnych centrów danych.

To właśnie dzięki takiemu treningowi systemy AI potrafią dziś analizować obrazy, rozpoznawać mowę czy generować naturalnie brzmiące teksty.

Deep learning – silnik współczesnej sztucznej inteligencji

Deep learning to zaawansowana forma uczenia maszynowego oparta na bardzo dużych sieciach neuronowych. Termin ten odnosi się do modeli posiadających wiele warstw przetwarzania danych, dzięki czemu mogą analizować niezwykle złożone informacje.

Technologia deep learning odegrała kluczową rolę w rozwoju generatywnej AI oraz modeli językowych LLM.

CNN – sieci konwolucyjne

Convolutional Neural Networks (CNN) są szczególnie skuteczne w analizie obrazów. Dzięki specjalnej architekturze sieci mogą identyfikować wzorce wizualne takie jak krawędzie, kształty czy tekstury.

Systemy AI oparte na CNN są wykorzystywane między innymi w medycynie, systemach monitoringu oraz autonomicznych pojazdach.

RNN – sieci rekurencyjne

Recurrent Neural Networks (RNN) zostały zaprojektowane do analizy danych sekwencyjnych, takich jak tekst czy sygnały dźwiękowe. Sieci te potrafią uwzględniać wcześniejsze elementy sekwencji podczas analizy kolejnych danych.

Choć dziś wiele zastosowań RNN zostało zastąpionych przez transformery, odegrały one ważną rolę w rozwoju technologii przetwarzania języka naturalnego.

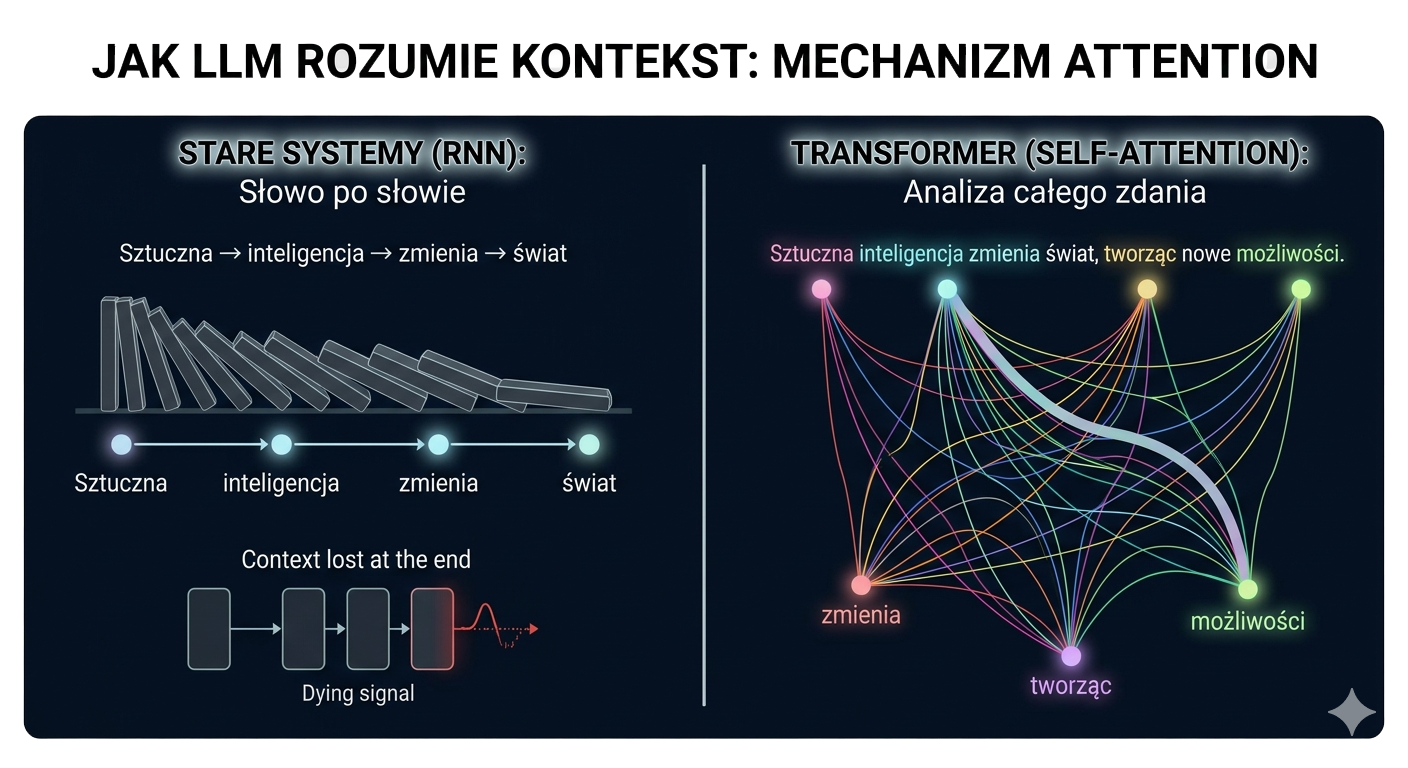

Transformery – przełom w AI

Największy przełom w rozwoju sztucznej inteligencji nastąpił wraz z wprowadzeniem architektury transformerów. Modele te wykorzystują mechanizm attention, który pozwala analizować relacje między elementami danych w całym kontekście.

To właśnie transformery stały się podstawą dla modeli językowych LLM oraz systemów generatywnej AI.

Modele językowe LLM – jak działa generatywna sztuczna inteligencja (AI)

Jednym z najważniejszych osiągnięć współczesnej sztucznej inteligencji są modele językowe LLM (Large Language Models). Są to ogromne sieci neuronowe trenowane na miliardach fragmentów tekstu z internetu, książek i artykułów naukowych.

Dzięki temu AI potrafi analizować język naturalny i generować nowe treści w sposób przypominający ludzką komunikację.

Tokeny

Podstawową jednostką przetwarzania w modelach językowych LLM są tokeny. Token może być słowem, fragmentem słowa lub znakiem interpunkcyjnym.

Podczas analizy tekstu sztuczna inteligencja przekształca zdania w sekwencję tokenów, które następnie są analizowane przez sieć neuronową.

Embeddingi

Embeddingi to matematyczne reprezentacje słów lub tokenów w przestrzeni wielowymiarowej. Dzięki nim AI potrafi rozpoznawać podobieństwa między słowami i rozumieć ich kontekst semantyczny.

Na przykład słowa „samochód”, „auto” i „pojazd” mogą znajdować się blisko siebie w przestrzeni embeddingów.

Kontekst

Najważniejszą cechą nowoczesnych modeli językowych LLM jest zdolność analizowania kontekstu. System AI nie interpretuje słów w izolacji, lecz uwzględnia całe zdanie, a często nawet dłuższy fragment rozmowy.

Dzięki temu generatywna AI potrafi odpowiadać na pytania, pisać artykuły, generować kod czy prowadzić złożone rozmowy z użytkownikami.

Jak działa sztuczna inteligencja (AI) krok po kroku

Aby zrozumieć działanie sztucznej inteligencji (AI), warto prześledzić proces powstawania odpowiedzi generowanej przez systemy takie jak modele językowe LLM.

Proces działania AI można uprościć do kilku etapów:

1. Zbieranie danych

Modele AI są trenowane na ogromnych zbiorach danych obejmujących teksty, obrazy, kod komputerowy i inne informacje pochodzące z internetu, książek czy artykułów naukowych.

2. Trenowanie modelu

Algorytmy uczenia maszynowego analizują dane i uczą się zależności między słowami, obrazami i innymi elementami informacji.

3. Analiza zapytania użytkownika

Gdy użytkownik wpisuje pytanie, AI przekształca tekst w tokeny i analizuje ich znaczenie w kontekście całej wypowiedzi.

4. Generowanie odpowiedzi

Na podstawie kontekstu model językowy LLM przewiduje najbardziej prawdopodobną sekwencję słów, która stanowi odpowiedź.

5. Optymalizacja odpowiedzi

W wielu systemach AI odpowiedzi są dodatkowo filtrowane i optymalizowane, aby zwiększyć ich trafność i bezpieczeństwo.

Dzięki temu procesowi generatywna AI może prowadzić rozmowy, pisać teksty i analizować informacje w sposób przypominający ludzką komunikację.

Rewolucja transformerów – dlaczego sztuczna inteligencja (AI) eksplodowała po 2017 roku

Przez wiele lat rozwój sztucznej inteligencji postępował stopniowo. Algorytmy uczenia maszynowego poprawiały swoje wyniki, a sieci neuronowe stawały się coraz większe i bardziej złożone. Jednak dopiero w drugiej połowie drugiej dekady XXI wieku nastąpił moment, który całkowicie zmienił trajektorię rozwoju AI.

Tym momentem była publikacja naukowa z 2017 roku zatytułowana “Attention Is All You Need”. Artykuł przygotowany przez zespół badaczy z Google Brain i Google Research zaprezentował nową architekturę sieci neuronowych – transformery. Model ten okazał się przełomowy dla przetwarzania języka naturalnego i w krótkim czasie stał się fundamentem współczesnej generatywnej AI.

Transformery rozwiązały jeden z największych problemów wcześniejszych systemów AI: trudność w analizowaniu długich fragmentów tekstu oraz rozumieniu zależności między słowami oddalonymi od siebie w zdaniu. Dzięki nowej architekturze modele mogły analizować cały kontekst jednocześnie, a nie krok po kroku, jak w starszych sieciach neuronowych.

To właśnie na tej technologii opierają się dziś najpotężniejsze modele językowe LLM, takie jak GPT, Claude, Gemini czy LLaMA. Bez transformerów współczesna eksplozja sztucznej inteligencji prawdopodobnie nie byłaby możliwa.

Publikacja “Attention Is All You Need” – punkt zwrotny w rozwoju AI

Publikacja “Attention Is All You Need” została zaprezentowana w 2017 roku podczas konferencji NeurIPS, jednej z najważniejszych konferencji naukowych w dziedzinie uczenia maszynowego. Autorzy zaproponowali w niej całkowicie nowe podejście do analizy danych sekwencyjnych, takich jak tekst czy mowa.

Wcześniejsze systemy sztucznej inteligencji opierały się głównie na sieciach rekurencyjnych (RNN) oraz ich rozwinięciach, takich jak LSTM. Modele te analizowały tekst krok po kroku, przetwarzając słowa w kolejności ich występowania. Choć rozwiązanie to było skuteczne, miało poważne ograniczenia – szczególnie przy analizie długich tekstów.

Transformery wprowadziły zupełnie inną koncepcję. Zamiast analizować tekst sekwencyjnie, model może przetwarzać wszystkie słowa jednocześnie, analizując relacje między nimi w całym kontekście. Dzięki temu AI może znacznie lepiej rozumieć znaczenie zdań oraz powiązania między fragmentami tekstu.

Ta zmiana architektury okazała się jednym z najważniejszych momentów w historii sztucznej inteligencji i zapoczątkowała rozwój ogromnych modeli językowych LLM, które dziś napędzają generatywną AI.

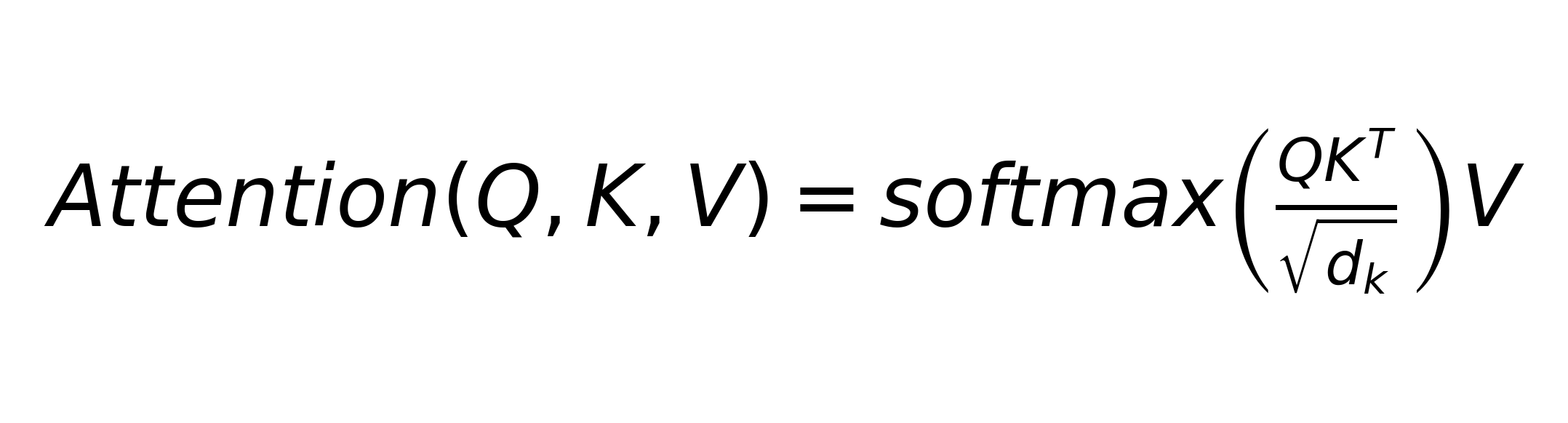

Mechanizm attention – serce nowoczesnej AI

Jednym z najważniejszych przełomów w rozwoju współczesnej sztucznej inteligencji (AI) był mechanizm attention, opisany w przełomowej pracy naukowej Attention Is All You Need z 2017 roku. To właśnie on stał się fundamentem architektury Transformer, na której opierają się dzisiejsze modele językowe LLM takie jak GPT, Gemini czy Claude.

Mechanizm attention pozwala modelowi sztucznej inteligencji określić, które fragmenty danych wejściowych są najważniejsze w danym kontekście. Zamiast analizować każde słowo w izolacji, model może „skupić uwagę” na tych elementach zdania, które mają największy wpływ na znaczenie całej wypowiedzi.

W praktyce oznacza to, że AI potrafi analizować relacje między słowami w zdaniu, nawet jeśli znajdują się one daleko od siebie. Dzięki temu modele językowe mogą lepiej rozumieć kontekst, sens wypowiedzi oraz zależności między elementami tekstu.

Wzór na Attention Mechanism

Podstawowy mechanizm wykorzystywany w architekturze Transformer to tzw. Scaled Dot-Product Attention.

Co oznaczają poszczególne elementy wzoru

Q (Query – zapytanie)

reprezentuje element, dla którego model próbuje znaleźć kontekst.

K (Key – klucz)

wektory reprezentujące wszystkie elementy wejściowe, z którymi porównywane jest zapytanie.

V (Value – wartość)

wektory zawierające właściwą treść informacji, która zostanie wykorzystana do wygenerowania odpowiedzi.

QKᵀ (iloczyn skalarny)

określa podobieństwo między zapytaniem a kluczami.

√dₖ (skalowanie)

zapobiega zbyt dużym wartościom przed zastosowaniem funkcji softmax.

softmax

zamienia wyniki na rozkład wag, który określa, jak bardzo model powinien „skupić się” na danym elemencie.

Jak działa mechanizm attention w praktyce

Proces działania mechanizmu attention można uprościć do trzech kroków:

1. Obliczenie podobieństwa

Model porównuje zapytanie (Query) z wszystkimi kluczami (Keys), obliczając ich podobieństwo.

2. Normalizacja wag

Wyniki są przekształcane przez funkcję softmax, która zamienia je na wartości od 0 do 1.

3. Tworzenie wektora kontekstu

Uzyskane wagi są mnożone przez Values, dzięki czemu model tworzy końcowy wektor reprezentujący kontekst.

Dzięki temu mechanizmowi sztuczna inteligencja potrafi uwzględniać zależności między elementami danych i generować bardziej trafne odpowiedzi.

Najważniejsze rodzaje mechanizmu attention

W nowoczesnych systemach AI wykorzystuje się kilka wariantów mechanizmu attention.

Self-Attention (samo-uwaga)

pozwala modelowi analizować relacje między elementami w obrębie tego samego zdania.

Multi-Head Attention

mechanizm działa równolegle w wielu „głowicach”, dzięki czemu model może jednocześnie analizować różne typy zależności między elementami danych.

Przetwarzanie kontekstu w modelach językowych LLM

Jednym z największych przełomów w rozwoju AI była zdolność do analizowania kontekstu. W języku naturalnym znaczenie słowa często zależy od całego zdania lub nawet całej rozmowy.

Dzięki architekturze transformerów sztuczna inteligencja może uwzględniać szeroki kontekst podczas generowania odpowiedzi. W praktyce oznacza to, że model analizuje nie tylko pojedyncze zdanie, ale także wcześniejsze fragmenty rozmowy lub dokumentu.

To właśnie dlatego generatywna AI potrafi dziś:

-

prowadzić długie rozmowy z użytkownikiem

-

analizować artykuły naukowe

-

generować spójne teksty liczące tysiące słów

-

pisać kod komputerowy

Im większy kontekst potrafi przetworzyć model, tym bardziej złożone zadania może wykonywać AI.

Skalowanie modeli – dlaczego większa sztuczna inteligencja (AI) działa lepiej

Jedną z najbardziej zaskakujących obserwacji w rozwoju sztucznej inteligencji jest tzw. prawo skalowania modeli. Badacze zauważyli, że zwiększanie liczby parametrów w modelach neuronowych prowadzi do znaczącej poprawy ich zdolności.

Oznacza to, że większe modele AI – trenowane na większych zbiorach danych i przy użyciu większej mocy obliczeniowej – mogą osiągać znacznie lepsze wyniki w analizie języka i generowaniu treści.

Dlatego właśnie współczesne modele językowe LLM posiadają setki miliardów parametrów i są trenowane na ogromnych zbiorach danych obejmujących niemal cały internet.

Skalowanie modeli wymaga jednak ogromnych zasobów technologicznych. Trenowanie jednego dużego modelu AI może kosztować setki milionów dolarów i wymagać wykorzystania tysięcy procesorów GPU w centrach danych.

Dlaczego rozwój sztucznej inteligencji (AI) tak przyspieszył

Jeszcze na początku XXI wieku AI była technologią o ograniczonych możliwościach. Dopiero w ostatniej dekadzie nastąpił gwałtowny rozwój sztucznej inteligencji.

Za ten postęp odpowiadają trzy kluczowe czynniki.

1. Ogromne ilości danych

Internet stał się największym źródłem danych treningowych dla modeli językowych LLM. Miliardy tekstów, obrazów i nagrań pozwoliły systemom AI nauczyć się rozpoznawania wzorców w niespotykanej wcześniej skali.

2. Potężna infrastruktura obliczeniowa

Rozwój procesorów GPU i centrów danych umożliwił trenowanie ogromnych modeli AI posiadających setki miliardów parametrów.

3. Nowe architektury sieci neuronowych

Przełomem była architektura transformerów, która stała się podstawą dla generatywnej AI i nowoczesnych modeli językowych LLM.

Dzięki tym trzem czynnikom sztuczna inteligencja rozwija się dziś szybciej niż jakakolwiek wcześniejsza technologia cyfrowa.

Fundament współczesnej AI – GPT, Claude, Gemini i LLaMA

Architektura transformerów stała się podstawą dla niemal wszystkich nowoczesnych systemów generatywnej AI. Najważniejsze modele językowe LLM rozwijane dziś przez największe firmy technologiczne bazują właśnie na tej koncepcji.

Do najważniejszych należą:

-

GPT rozwijany przez OpenAI

-

Claude tworzony przez firmę Anthropic

-

Gemini rozwijany przez Google DeepMind

-

LLaMA rozwijany przez Meta

Choć każdy z tych systemów posiada własne rozwiązania technologiczne i strategie treningowe, ich fundament pozostaje ten sam: architektura transformerów zaproponowana w pracy “Attention Is All You Need”.

To właśnie dzięki temu przełomowi sztuczna inteligencja w ciągu kilku lat przeszła drogę od narzędzia analitycznego do technologii zdolnej generować teksty, obrazy, muzykę i wideo. Transformery stały się więc jednym z najważniejszych wynalazków w historii współczesnej informatyki i fundamentem rozwoju przyszłości sztucznej inteligencji.

Najważniejsze modele AI – porównanie (stan na marzec 2026)

Rynek sztucznej inteligencji (AI) rozwija się w niezwykle szybkim tempie. W ciągu zaledwie kilku lat powstało kilka bardzo zaawansowanych modeli językowych LLM, które potrafią analizować tekst, generować kod, rozumieć obrazy, a nawet tworzyć wideo.

Największe firmy technologiczne – takie jak OpenAI, Google, Anthropic, Meta czy xAI – konkurują ze sobą w tworzeniu coraz bardziej zaawansowanych modeli generatywnej AI. Systemy te różnią się jednak możliwościami, architekturą oraz zastosowaniami.

Poniższa tabela przedstawia najważniejsze modele sztucznej inteligencji dostępne obecnie na rynku.

| Model AI | Firma | Typ modelu | Najważniejsze zastosowania |

|---|---|---|---|

| GPT-4 / GPT-5 | OpenAI | modele językowe LLM | generowanie tekstu, programowanie, analiza danych |

| Gemini | Google DeepMind | multimodalny model AI | wyszukiwanie informacji, analiza danych, integracja z usługami Google |

| Claude | Anthropic | modele językowe LLM | analiza dokumentów, bezpieczeństwo AI, praca z dużymi tekstami |

| LLaMA | Meta | open-source LLM | badania nad AI, projekty open source, rozwój własnych modeli |

| Grok | xAI | modele językowe LLM | integracja z platformą X, analiza informacji w czasie rzeczywistym |

Lista modeli AI szybko się zmienia, ponieważ firmy technologiczne regularnie wprowadzają nowe wersje swoich systemów sztucznej inteligencji.

Jak konkurencja między modelami AI wpływa na rozwój technologii

Rywalizacja między firmami rozwijającymi sztuczną inteligencję jest jednym z głównych motorów postępu technologicznego. Każda kolejna generacja modeli językowych LLM jest większa, bardziej zaawansowana i potrafi analizować coraz bardziej złożone dane.

W praktyce oznacza to, że generatywna AI rozwija się dziś szybciej niż jakakolwiek wcześniejsza technologia cyfrowa. Modele sztucznej inteligencji są wykorzystywane nie tylko do tworzenia tekstów czy obrazów, ale także w badaniach naukowych, analizie danych, programowaniu oraz automatyzacji pracy.

Dlatego wielu ekspertów uważa, że rozwój AI w najbliższych latach będzie jednym z kluczowych czynników kształtujących gospodarkę, naukę i globalną rywalizację technologiczną.

Jak powstają modele sztucznej inteligencji (AI)

Rozwój nowoczesnej sztucznej inteligencji (AI) jest w dużej mierze wynikiem ogromnego postępu w trzech obszarach: dostępie do gigantycznych zbiorów danych, rosnącej mocy obliczeniowej oraz coraz bardziej zaawansowanych architekturach sieci neuronowych. Współczesne modele językowe LLM i systemy generatywnej AI nie powstają w klasyczny sposób, w którym programista pisze kod opisujący dokładne reguły działania programu. Zamiast tego modele są trenowane na ogromnych zbiorach danych, dzięki czemu uczą się rozpoznawać wzorce, zależności i kontekst.

Proces tworzenia nowoczesnego modelu AI jest niezwykle złożony i może trwać wiele miesięcy. Obejmuje on przygotowanie danych treningowych, trenowanie sieci neuronowej na ogromnej infrastrukturze obliczeniowej oraz wieloetapową optymalizację modelu. Największe firmy technologiczne inwestują w ten proces setki milionów dolarów, ponieważ rozwój potężnych modeli językowych LLM stał się jednym z kluczowych obszarów globalnej rywalizacji technologicznej.

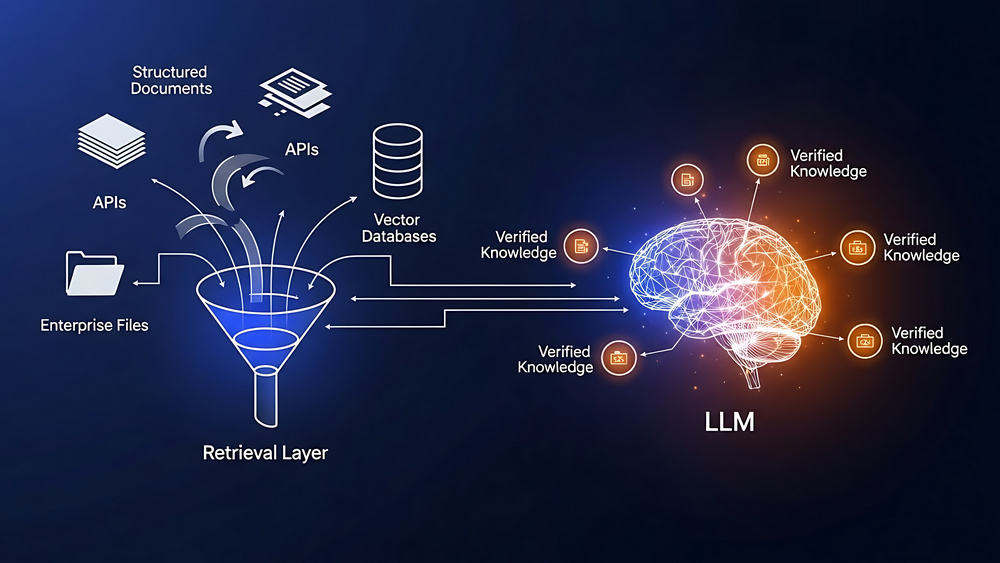

Dane treningowe – paliwo dla sztucznej inteligencji

Podstawą działania każdej AI są dane treningowe. Bez ogromnych zbiorów danych nawet najbardziej zaawansowana architektura sieci neuronowej nie byłaby w stanie nauczyć się analizować języka czy generować treści.

Współczesne modele językowe LLM są trenowane na ogromnych zbiorach tekstów pochodzących z wielu źródeł. Dane te pozwalają systemom AI nauczyć się struktury języka, zależności semantycznych oraz sposobów formułowania wypowiedzi.

Do najważniejszych źródeł danych treningowych należą:

Internet

Największym źródłem danych dla współczesnej sztucznej inteligencji jest internet. Strony internetowe, fora dyskusyjne, blogi czy dokumentacja techniczna stanowią ogromne repozytorium wiedzy o języku i świecie.

Dzięki analizie miliardów stron internetowych AI może uczyć się różnych stylów pisania, struktur argumentacji oraz sposobów rozwiązywania problemów.

Książki

Książki są szczególnie cennym źródłem danych dla modeli językowych LLM, ponieważ zawierają długie i spójne narracje. W przeciwieństwie do krótkich wpisów w internecie pozwalają one modelowi AI zrozumieć bardziej złożone struktury tekstu.

Literatura, publikacje naukowe i podręczniki pomagają sztucznej inteligencji rozwijać zdolność analizowania kontekstu oraz budowania logicznych argumentów.

Artykuły

Artykuły prasowe i naukowe dostarczają AI wiedzy o aktualnych wydarzeniach, nauce, technologii i gospodarce. Dzięki nim modele językowe LLM mogą generować odpowiedzi oparte na szerokim zakresie tematów.

Wiele zbiorów treningowych zawiera również materiały edukacyjne, dokumenty publiczne oraz teksty dostępne w otwartych repozytoriach wiedzy.

Kod

Ważnym elementem danych treningowych dla AI jest również kod komputerowy. Repozytoria open source, takie jak GitHub, dostarczają milionów przykładów programów napisanych w różnych językach.

Dzięki temu generatywna AI potrafi dziś nie tylko analizować kod, ale również go tworzyć. Narzędzia oparte na modelach językowych LLM są w stanie generować fragmenty programów, pomagać w debugowaniu oraz automatyzować wiele zadań programistycznych.

Proces treningu sztucznej inteligencji

Trenowanie nowoczesnego modelu AI polega na analizie ogromnych zbiorów danych i stopniowym dostosowywaniu parametrów sieci neuronowej. W przypadku największych modeli językowych LLM liczba parametrów może sięgać setek miliardów.

Podczas treningu model AI analizuje ogromną liczbę przykładów i próbuje przewidzieć kolejne słowo w zdaniu. Jeśli przewidywanie jest błędne, algorytm koryguje swoje parametry. Proces ten powtarza się miliardy razy, aż model osiągnie wysoką dokładność.

Ten etap wymaga ogromnej mocy obliczeniowej, dlatego rozwój sztucznej inteligencji jest ściśle związany z postępem w technologii sprzętowej.

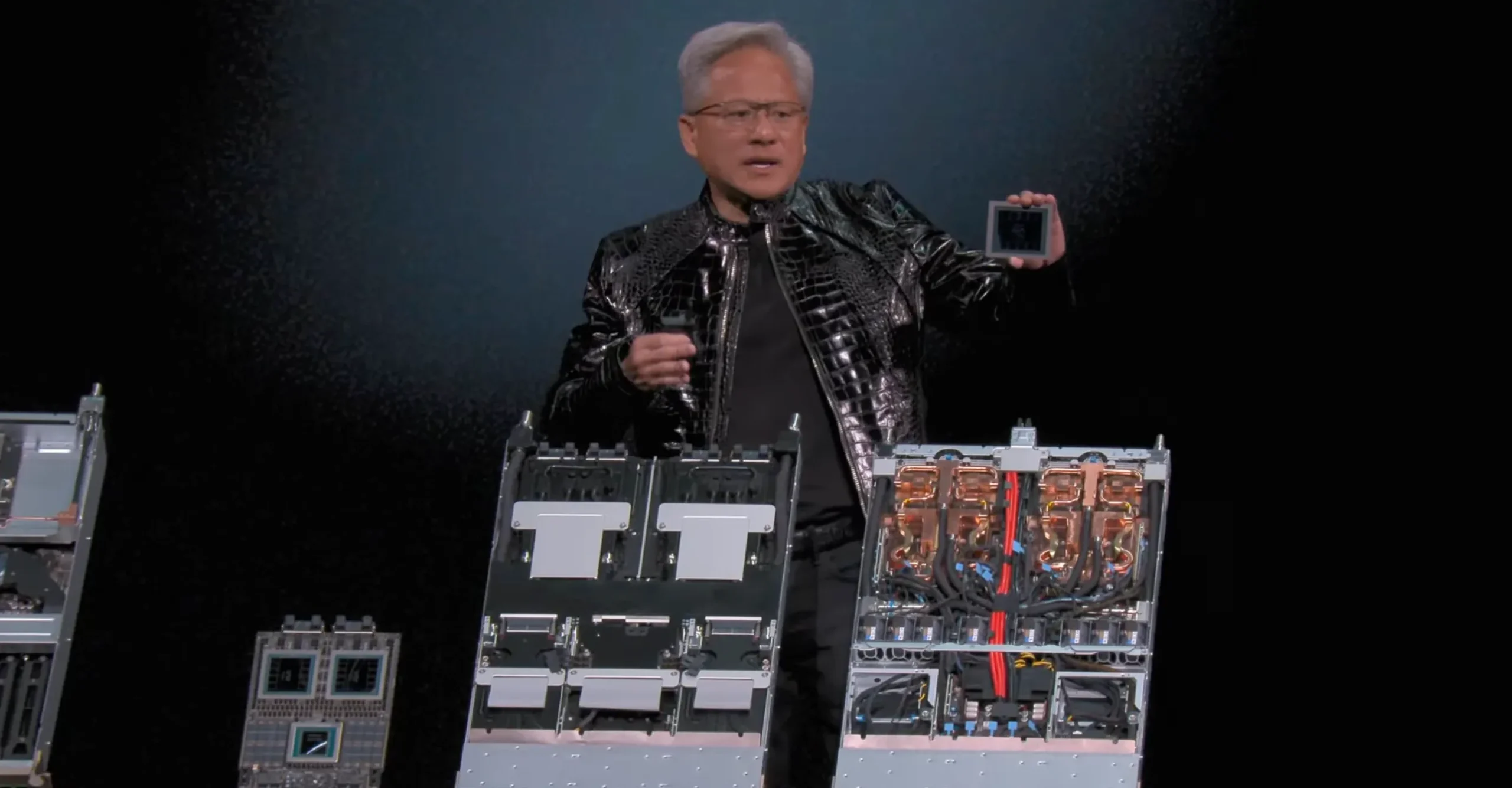

GPU – silnik współczesnej AI

Najważniejszą rolę w trenowaniu modeli AI odgrywają procesory graficzne (GPU). Choć pierwotnie zostały zaprojektowane do renderowania grafiki komputerowej, okazały się niezwykle skuteczne w wykonywaniu równoległych obliczeń matematycznych.

Sieci neuronowe wymagają wykonywania ogromnej liczby operacji macierzowych. GPU są w stanie wykonywać takie operacje znacznie szybciej niż klasyczne procesory CPU, dlatego stały się fundamentem infrastruktury sztucznej inteligencji.

Firma NVIDIA jest obecnie jednym z najważniejszych dostawców sprzętu dla sektora AI.

TPU – specjalistyczne procesory dla AI

Google opracował własne układy obliczeniowe przeznaczone specjalnie do trenowania AI. Są to tzw. TPU (Tensor Processing Units).

Procesory TPU zostały zaprojektowane z myślą o operacjach wykorzystywanych w sieciach neuronowych, dzięki czemu mogą znacznie przyspieszyć trening modeli językowych LLM.

Google wykorzystuje TPU między innymi do trenowania modeli Gemini, które stanowią jedną z najważniejszych platform generatywnej AI na świecie.

Superkomputery dla sztucznej inteligencji

Największe modele AI są trenowane na ogromnych klastrach obliczeniowych składających się z tysięcy procesorów GPU lub TPU. Takie systemy często określa się mianem superkomputerów przeznaczonych do rozwoju sztucznej inteligencji.

Przykładowo infrastruktura używana do trenowania modeli językowych LLM może składać się z:

-

tysięcy procesorów GPU

-

setek petabajtów danych

-

zaawansowanych systemów chłodzenia i zarządzania energią

Tego typu centra danych zużywają ogromne ilości energii i stanowią jeden z najdroższych elementów rozwoju AI.

Koszt trenowania modeli AI

Rozwój najpotężniejszych systemów sztucznej inteligencji jest niezwykle kosztowny. Trenowanie jednego dużego modelu językowego LLM może kosztować od kilkudziesięciu do nawet kilkuset milionów dolarów.

Koszty obejmują nie tylko sprzęt i energię elektryczną, ale także przygotowanie danych, rozwój oprogramowania oraz pracę zespołów badawczych.

Koszt trenowania GPT-4

Model GPT-4 opracowany przez OpenAI jest jednym z najbardziej znanych przykładów nowoczesnej generatywnej AI. Szacuje się, że koszt jego trenowania mógł przekroczyć 100 milionów dolarów.

Proces treningu obejmował analizę ogromnych zbiorów danych oraz wykorzystanie potężnych klastrów GPU.

Koszt trenowania Claude

Firma Anthropic rozwija własne modele językowe LLM pod nazwą Claude. Choć dokładne koszty nie są publicznie znane, analitycy szacują, że trenowanie kolejnych generacji modeli Claude również wymaga inwestycji liczonych w dziesiątkach lub setkach milionów dolarów.

Anthropic koncentruje się szczególnie na bezpieczeństwie AI oraz metodach kontrolowania zachowania dużych modeli językowych.

Koszt trenowania Gemini

Google DeepMind rozwija rodzinę modeli Gemini, które są jednymi z najbardziej zaawansowanych systemów generatywnej AI na świecie. Trenowanie tych modeli wymaga ogromnej infrastruktury obliczeniowej opartej na procesorach TPU oraz globalnej sieci centrów danych Google.

Szacuje się, że całkowite koszty rozwoju największych modeli AI mogą sięgać setek milionów dolarów, a w przyszłości nawet miliardów.

Rozwój tak kosztownych systemów pokazuje, że sztuczna inteligencja stała się jednym z najważniejszych obszarów globalnej rywalizacji technologicznej. Największe firmy świata inwestują ogromne środki w rozwój modeli językowych LLM i generatywnej AI, ponieważ technologia ta może w przyszłości zmienić niemal każdy sektor gospodarki.

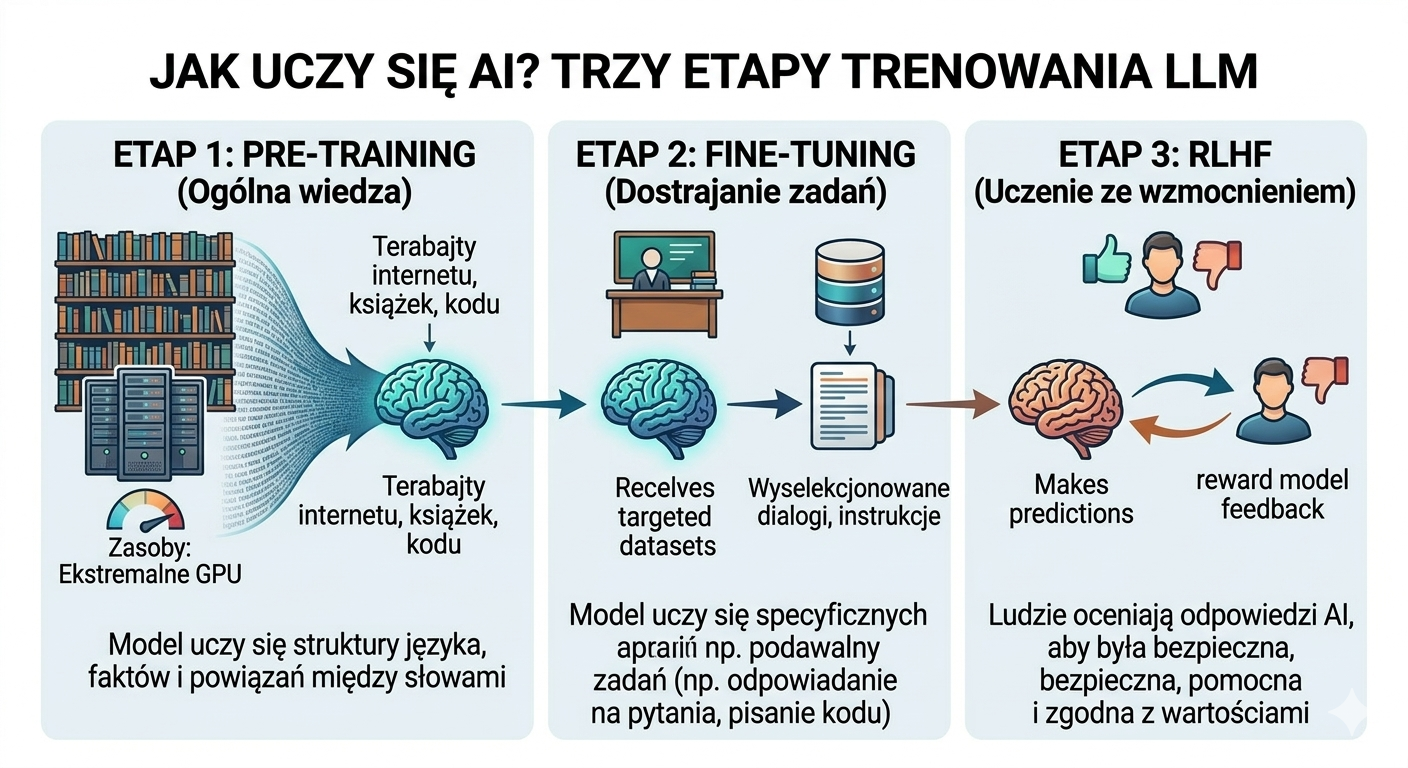

Jak uczy się sztuczna inteligencja? Trzy etapy trenowania modeli LLM

Nowoczesne modele językowe LLM, takie jak GPT, Gemini czy Claude, nie są zaprogramowane ręcznie przez programistów. Zamiast tego uczą się na ogromnych zbiorach danych, analizując miliardy tekstów i dokumentów.

Proces uczenia sztucznej inteligencji (AI) jest złożony i wymaga ogromnej mocy obliczeniowej. W uproszczeniu można go podzielić na trzy główne etapy.

1️⃣ Pre-training – trenowanie na ogromnych zbiorach danych

Pierwszym etapem jest tzw. pre-training, czyli wstępne trenowanie modelu.

Na tym etapie model analizuje ogromne ilości danych tekstowych, takich jak:

-

strony internetowe

-

książki

-

artykuły naukowe

-

dokumentacja techniczna

-

kod programistyczny

Model nie uczy się wprost znaczenia słów, lecz statystycznych zależności między nimi. Dzięki temu potrafi przewidywać kolejne słowo w zdaniu i generować spójne wypowiedzi.

To właśnie ten etap sprawia, że modele językowe LLM posiadają ogromną wiedzę o języku i świecie.

2️⃣ Fine-tuning – dostrajanie modelu

Po wstępnym treningu model przechodzi etap fine-tuning, czyli dostrajania.

Na tym etapie system uczy się wykonywać konkretne zadania, takie jak:

-

odpowiadanie na pytania

-

tłumaczenie tekstów

-

generowanie kodu

-

analiza dokumentów

Fine-tuning pozwala dopasować model do konkretnych zastosowań i zwiększyć jego dokładność.

3️⃣ RLHF – uczenie przez informację zwrotną od ludzi

Trzecim etapem jest tzw. RLHF (Reinforcement Learning from Human Feedback).

W tym procesie ludzie oceniają odpowiedzi generowane przez AI, a model uczy się na podstawie tych ocen.

Dzięki temu:

-

odpowiedzi są bardziej naturalne

-

model unika błędnych lub niebezpiecznych treści

-

system lepiej dopasowuje się do oczekiwań użytkowników

To właśnie dzięki tej metodzie nowoczesne systemy AI mogą prowadzić naturalne rozmowy z użytkownikami.

Najważniejsze firmy rozwijające sztuczną inteligencję (AI)

Rozwój współczesnej sztucznej inteligencji (AI) jest napędzany przez kilka globalnych firm technologicznych, które inwestują miliardy dolarów w badania nad nowymi algorytmami, infrastrukturą obliczeniową oraz ogromnymi modelami językowymi LLM. To właśnie dzięki ich pracy generatywna AI stała się jedną z najważniejszych technologii XXI wieku.

Firmy te konkurują nie tylko o dominację na rynku technologicznym, ale także o wpływ na przyszłość gospodarki, nauki i społeczeństwa. W praktyce oznacza to globalny wyścig technologiczny, w którym rozwój sztucznej inteligencji staje się strategicznym elementem przewagi gospodarczej.

Do najważniejszych graczy w świecie AI należą OpenAI, Google DeepMind, Anthropic, Microsoft, Meta oraz NVIDIA. Każda z tych firm rozwija własne modele językowe LLM, platformy generatywnej AI oraz infrastrukturę obliczeniową potrzebną do trenowania coraz większych systemów.

OpenAI – lider rewolucji generatywnej AI

OpenAI jest jedną z najbardziej wpływowych firm w świecie sztucznej inteligencji. Organizacja powstała w 2015 roku jako inicjatywa badawcza mająca na celu rozwój bezpiecznej i dostępnej AI. W ciągu kilku lat stała się jednym z głównych liderów technologii modeli językowych LLM.

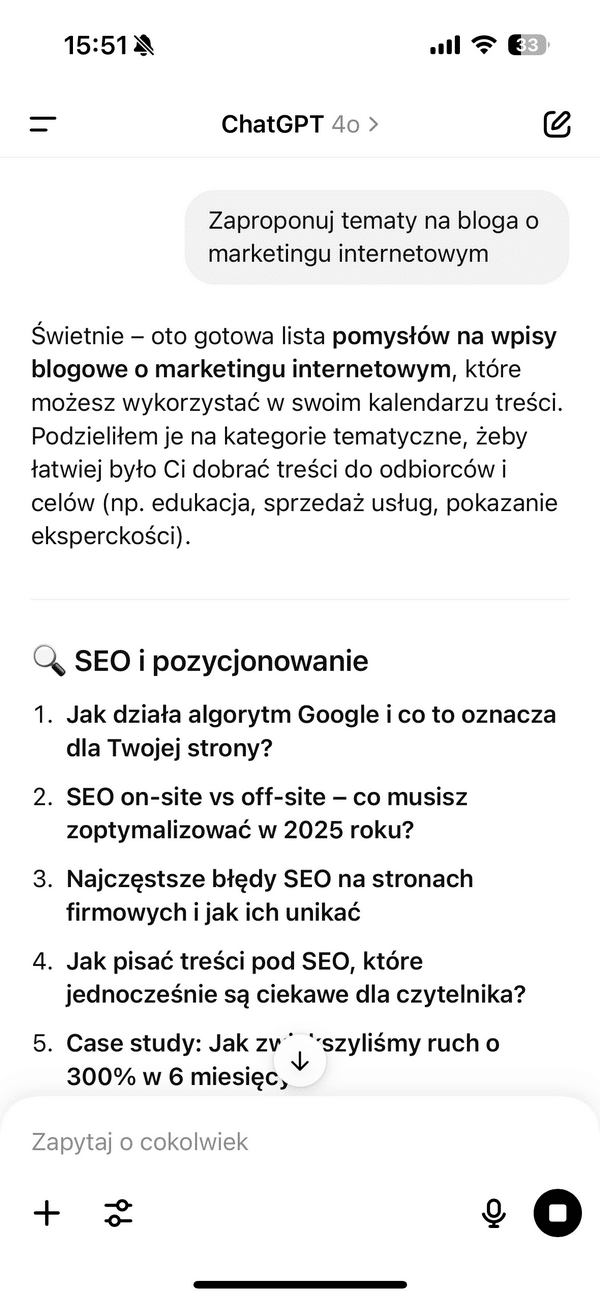

Największą popularność OpenAI przyniósł system ChatGPT, który wprowadził generatywną AI do codziennego użytku milionów ludzi. Narzędzie to potrafi prowadzić rozmowy z użytkownikiem, generować teksty, pisać kod, analizować dokumenty i odpowiadać na pytania.

Do najważniejszych technologii rozwijanych przez OpenAI należą:

-

ChatGPT – jeden z najpopularniejszych systemów konwersacyjnej AI

-

GPT-4 i GPT-5 – zaawansowane modele językowe LLM wykorzystywane w wielu aplikacjach

-

DALL-E – system generatywnej AI tworzący obrazy na podstawie opisów tekstowych

-

Sora – model generujący realistyczne wideo przy użyciu sztucznej inteligencji

OpenAI odegrało kluczową rolę w popularyzacji generatywnej AI, pokazując, że sztuczna inteligencja może być narzędziem wykorzystywanym w codziennej pracy, edukacji i biznesie.

Google DeepMind – nauka i przełomy w AI

Google jest jednym z największych inwestorów w rozwój sztucznej inteligencji. Firma od lat prowadzi badania nad uczeniem maszynowym, sieciami neuronowymi i systemami AI zdolnymi do rozwiązywania skomplikowanych problemów naukowych.

W 2014 roku Google przejął firmę DeepMind, która później została połączona z zespołami badawczymi Google AI. W ten sposób powstała organizacja Google DeepMind, będąca jednym z najważniejszych ośrodków badań nad AI na świecie.

Do najważniejszych projektów tej firmy należą:

-

Gemini – zaawansowane modele językowe LLM rozwijane przez Google

-

AlphaGo – system AI, który pokonał mistrzów świata w grze Go

-

AlphaFold – przełomowa AI przewidująca struktury białek

Szczególnie projekt AlphaFold pokazał, że sztuczna inteligencja może mieć ogromny wpływ na naukę i medycynę. Model ten pozwolił naukowcom rozwiązać problem struktury białek, który przez dziesięciolecia był jednym z najtrudniejszych wyzwań biologii molekularnej.

Anthropic – bezpieczna AI i modele Claude

Anthropic to stosunkowo młoda firma technologiczna założona przez byłych badaczy OpenAI. Jej głównym celem jest rozwój sztucznej inteligencji, która będzie bardziej bezpieczna, przewidywalna i zgodna z wartościami użytkowników.

Najważniejszym projektem firmy jest Claude, rodzina dużych modeli językowych LLM przeznaczonych do analizowania tekstów, prowadzenia rozmów oraz wspierania pracy intelektualnej.

Modele Claude są szczególnie cenione za zdolność analizowania bardzo długich dokumentów i zachowywania spójnego kontekstu. Dzięki temu AI Anthropic jest wykorzystywana między innymi w analizie dokumentów prawnych, badaniach naukowych i zarządzaniu wiedzą w firmach.

Anthropic kładzie duży nacisk na rozwój bezpiecznej generatywnej AI, która minimalizuje ryzyko błędów, manipulacji informacją i niepożądanych zachowań modeli.

Microsoft – integracja AI z oprogramowaniem

Microsoft odegrał ogromną rolę w rozwoju współczesnej sztucznej inteligencji, głównie dzięki strategicznej inwestycji w OpenAI. Firma zainwestowała w rozwój tej technologii miliardy dolarów i zintegrowała modele językowe LLM z własnymi produktami.

Najbardziej znanym rozwiązaniem Microsoftu jest Copilot, czyli system AI wspierający użytkowników w pracy z dokumentami, kodem i analizą danych.

Technologia Copilot została zintegrowana z wieloma produktami firmy:

-

Microsoft 365

-

Windows

-

GitHub

-

platformą Azure

Dzięki temu sztuczna inteligencja staje się integralną częścią środowiska pracy wielu firm i organizacji.

Meta – rozwój open source AI

Firma Meta, znana przede wszystkim jako właściciel Facebooka i Instagrama, również odgrywa ważną rolę w rozwoju sztucznej inteligencji. W przeciwieństwie do wielu konkurentów firma ta promuje bardziej otwarte podejście do technologii AI.

Najważniejszym projektem Meta jest rodzina modeli LLaMA (Large Language Model Meta AI). Są to zaawansowane modele językowe LLM, które w wielu przypadkach zostały udostępnione społeczności badaczy i programistów.

Podejście open source pozwala naukowcom i firmom na całym świecie eksperymentować z technologią generatywnej AI, rozwijać własne aplikacje i budować nowe rozwiązania oparte na sztucznej inteligencji.

Meta uważa, że otwartość ekosystemu AI może przyspieszyć rozwój technologii i zapobiec monopolizacji rynku przez kilka największych firm.

NVIDIA – infrastruktura dla sztucznej inteligencji

Choć NVIDIA nie rozwija własnych modeli językowych LLM w takim stopniu jak inne firmy, odgrywa absolutnie kluczową rolę w ekosystemie AI. Firma jest największym producentem procesorów graficznych wykorzystywanych do trenowania i uruchamiania systemów sztucznej inteligencji.

Nowoczesne GPU firmy NVIDIA są fundamentem infrastruktury obliczeniowej dla większości projektów AI na świecie. To właśnie na tych układach trenowane są największe modele generatywnej AI, w tym GPT, Gemini czy Claude.

Procesory GPU pozwalają wykonywać ogromne ilości operacji matematycznych równolegle, co jest niezbędne przy trenowaniu dużych sieci neuronowych.

W praktyce oznacza to, że NVIDIA dostarcza technologiczną infrastrukturę, bez której rozwój współczesnej sztucznej inteligencji byłby znacznie wolniejszy.

Rozwój tych firm pokazuje, że sztuczna inteligencja stała się jednym z najważniejszych obszarów globalnej rywalizacji technologicznej. Każda z nich rozwija własne modele językowe LLM, platformy generatywnej AI oraz infrastrukturę obliczeniową, które będą kształtować przyszłość sztucznej inteligencji w kolejnych dekadach.

„Sztuczna inteligencja jest nową platformą obliczeniową, tak jak kiedyś internet czy smartfony.”

— Jensen Huang, CEO NVIDIA

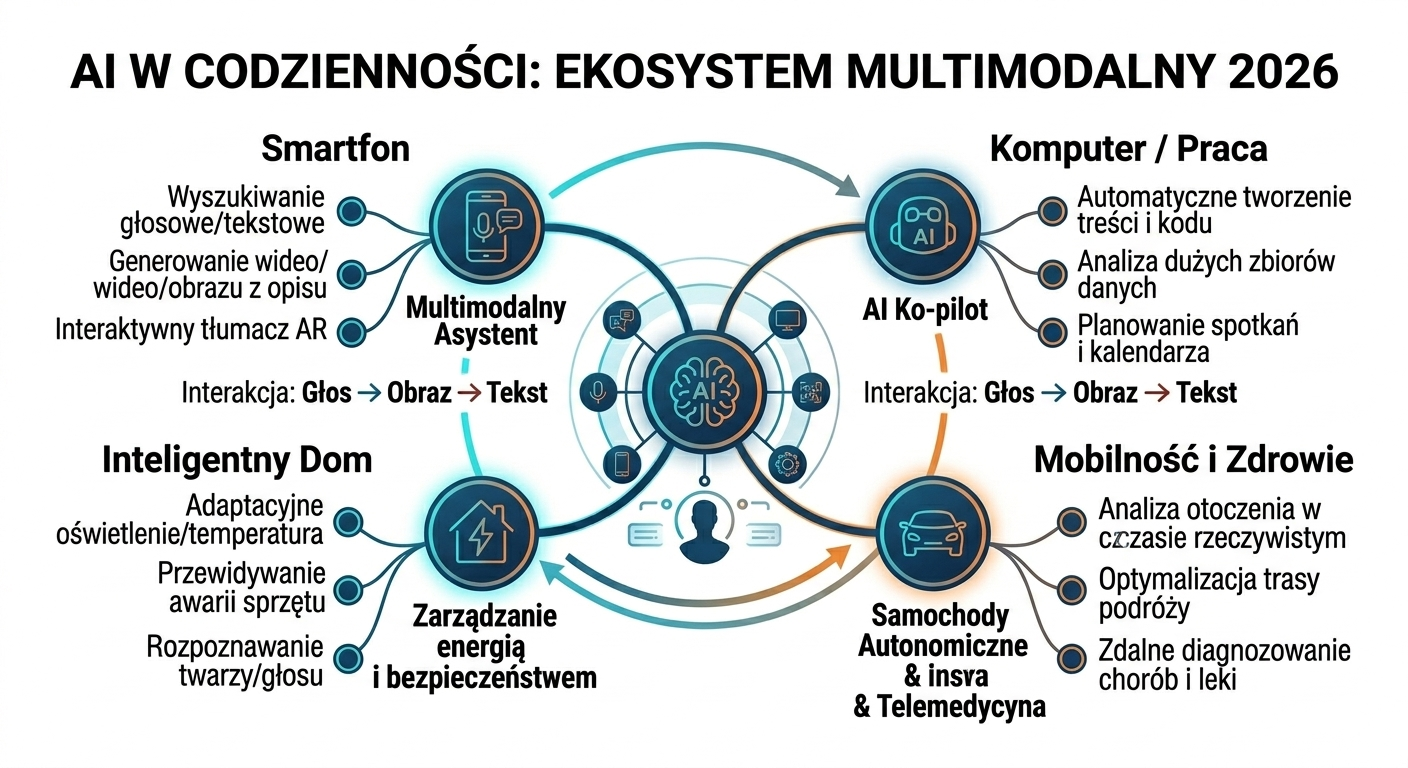

Sztuczna inteligencja (AI) w codziennym życiu

Jeszcze kilkanaście lat temu sztuczna inteligencja (AI) była technologią kojarzoną głównie z laboratoriami badawczymi i futurystycznymi wizjami przyszłości. Dziś jednak AI stała się integralną częścią codziennego życia milionów ludzi. Od wyszukiwania informacji w internecie, przez fotografię w smartfonach, aż po diagnostykę medyczną – sztuczna inteligencja działa w tle wielu usług i urządzeń, z których korzystamy każdego dnia.

Największą zmianę przyniósł rozwój modeli językowych LLM i generatywnej AI, które pozwoliły komputerom lepiej rozumieć język naturalny oraz analizować ogromne ilości danych. Dzięki temu AI przestała być narzędziem przeznaczonym wyłącznie dla specjalistów i zaczęła trafiać do aplikacji konsumenckich, smartfonów oraz systemów biznesowych.

W praktyce oznacza to, że sztuczna inteligencja coraz częściej wspiera użytkowników w codziennych zadaniach – od wyszukiwania informacji i organizowania pracy po analizę danych i podejmowanie decyzji.

Sztuczna inteligencja (AI) w internecie – nowe wyszukiwarki informacji

Jednym z obszarów, w którym sztuczna inteligencja zmienia sposób korzystania z technologii, jest internet. Tradycyjne wyszukiwarki opierały się głównie na indeksowaniu stron i dopasowywaniu słów kluczowych. Nowoczesne systemy AI potrafią jednak analizować znaczenie zapytań użytkownika i generować bezpośrednie odpowiedzi.

Dzięki modelom językowym LLM wyszukiwarki zaczynają przypominać bardziej rozmowę z ekspertem niż klasyczne wyszukiwanie informacji. Zamiast przeglądać dziesiątki stron internetowych, użytkownik może otrzymać syntetyczną odpowiedź przygotowaną przez AI.

Wyszukiwarki oparte na AI

Nowa generacja wyszukiwarek wykorzystuje generatywną sztuczną inteligencję, aby analizować ogromne zbiory informacji i przedstawiać użytkownikowi podsumowanie najważniejszych faktów.

Jednym z najbardziej znanych przykładów takiej technologii jest Perplexity, wyszukiwarka oparta na AI, która generuje odpowiedzi w oparciu o różne źródła internetowe. System analizuje dane, a następnie tworzy syntetyczne podsumowanie wraz z linkami do źródeł.

Takie rozwiązania pokazują, że sztuczna inteligencja może zmienić sposób, w jaki ludzie zdobywają wiedzę w internecie.

Sztuczna inteligencja w smartfonach

Smartfony są jednym z najważniejszych miejsc, w których AI działa niemal niezauważalnie dla użytkownika. Współczesne urządzenia mobilne wykorzystują sztuczną inteligencję do przetwarzania obrazów, analizy głosu oraz optymalizacji działania aplikacji.

Wiele funkcji, które dziś wydają się oczywiste, w rzeczywistości opiera się na zaawansowanych algorytmach AI.

AI w aparatach fotograficznych

Nowoczesne aparaty w smartfonach wykorzystują sztuczną inteligencję do poprawy jakości zdjęć. Algorytmy analizują scenę, rozpoznają obiekty i automatycznie dostosowują parametry fotografii.

Systemy AI mogą między innymi:

-

rozpoznawać twarze i postacie

-

poprawiać oświetlenie zdjęcia

-

redukować szumy w obrazie

-

symulować efekt profesjonalnych obiektywów

Dzięki temu nawet niewielkie aparaty w smartfonach mogą tworzyć zdjęcia o jakości porównywalnej z profesjonalnymi aparatami.

Asystenci głosowi i AI

Kolejnym przykładem zastosowania sztucznej inteligencji w smartfonach są asystenci głosowi. Systemy te wykorzystują modele językowe LLM oraz technologie rozpoznawania mowy, aby interpretować polecenia użytkownika.

Asystenci AI potrafią między innymi:

-

wyszukiwać informacje w internecie

-

ustawiać przypomnienia i alarmy

-

sterować urządzeniami w domu

-

odpowiadać na pytania użytkownika

Rozwój generatywnej AI sprawia, że asystenci głosowi stają się coraz bardziej zaawansowani i potrafią prowadzić bardziej naturalne rozmowy.

Sztuczna inteligencja (AI) w firmach – automatyzacja i analiza danych

Jednym z najważniejszych obszarów zastosowania sztucznej inteligencji jest biznes. Firmy wykorzystują AI do automatyzacji procesów, analizy danych oraz optymalizacji działań operacyjnych.

Dzięki modelom językowym LLM i systemom analitycznym AI przedsiębiorstwa mogą przetwarzać ogromne ilości informacji znacznie szybciej niż tradycyjne narzędzia informatyczne.

Automatyzacja procesów

Systemy AI są coraz częściej wykorzystywane do automatyzacji powtarzalnych zadań w firmach. Mogą one obsługiwać zapytania klientów, analizować dokumenty czy generować raporty.

Automatyzacja oparta na sztucznej inteligencji pozwala firmom zwiększyć efektywność pracy i ograniczyć koszty operacyjne.

Analityka danych

Kolejnym ważnym zastosowaniem AI jest analiza danych. Współczesne przedsiębiorstwa generują ogromne ilości informacji – od danych sprzedażowych po zachowania użytkowników w internecie.

Systemy sztucznej inteligencji potrafią analizować te dane i identyfikować ukryte wzorce, które mogą pomóc firmom podejmować lepsze decyzje biznesowe.

Sztuczna inteligencja w medycynie

Jednym z najbardziej obiecujących obszarów zastosowania AI jest medycyna. Dzięki analizie ogromnych zbiorów danych medycznych sztuczna inteligencja może wspierać lekarzy w diagnozowaniu chorób oraz planowaniu leczenia.

Rozwój AI w medycynie jest szczególnie ważny w kontekście starzejących się społeczeństw oraz rosnącego zapotrzebowania na opiekę zdrowotną.

Diagnostyka medyczna

Systemy AI potrafią analizować wyniki badań medycznych, zdjęcia rentgenowskie czy skany tomografii komputerowej. W wielu przypadkach sztuczna inteligencja osiąga dokładność porównywalną z najlepszymi specjalistami.

Algorytmy mogą pomagać w wykrywaniu chorób takich jak:

-

nowotwory

-

choroby serca

-

schorzenia neurologiczne

Analiza obrazów medycznych

Jednym z najbardziej zaawansowanych zastosowań AI jest analiza obrazów medycznych. Sieci neuronowe mogą wykrywać subtelne zmiany w obrazach diagnostycznych, które mogą być trudne do zauważenia dla ludzkiego oka.

Dzięki temu sztuczna inteligencja może wspierać lekarzy w szybszym i dokładniejszym wykrywaniu chorób.

Rozwój tych technologii pokazuje, że sztuczna inteligencja przestaje być abstrakcyjnym pojęciem z dziedziny informatyki. AI staje się infrastrukturą współczesnego świata cyfrowego – obecna w internecie, smartfonach, firmach i systemach opieki zdrowotnej.

W kolejnych latach znaczenie tych technologii będzie rosło, a ich rozwój będzie miał ogromny wpływ na przyszłość sztucznej inteligencji oraz sposób funkcjonowania społeczeństw.

Sztuczna inteligencja (AI) w gospodarce i biznesie

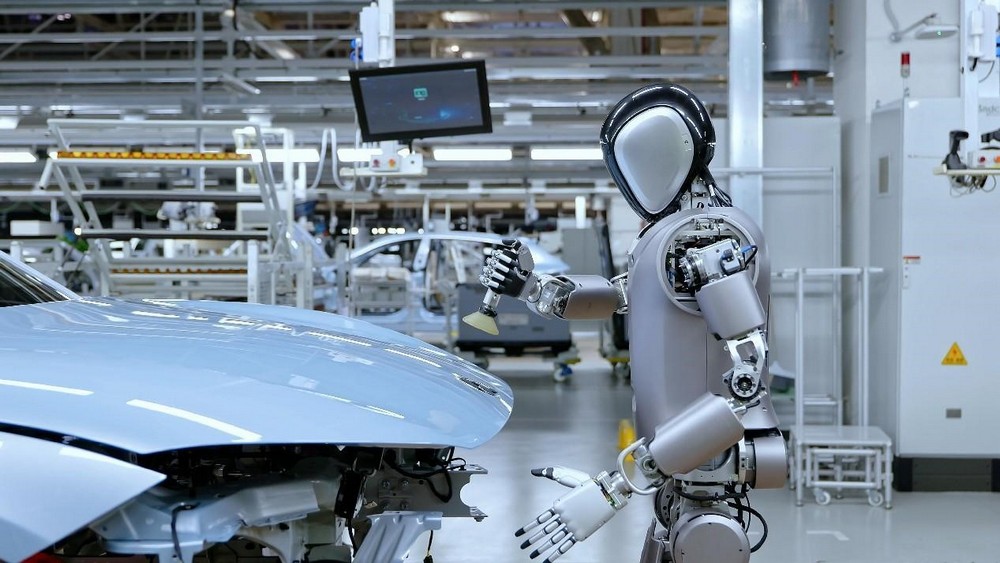

Rozwój sztucznej inteligencji (AI) staje się jednym z najważniejszych czynników zmieniających współczesną gospodarkę. W podobny sposób jak wcześniejsze rewolucje technologiczne – elektryfikacja, komputery czy internet – AI zaczyna wpływać na sposób funkcjonowania firm, strukturę rynku pracy oraz produktywność całych sektorów gospodarki.

W szczególności rozwój modeli językowych LLM i generatywnej AI sprawił, że automatyzacji zaczęły podlegać nie tylko zadania fizyczne lub administracyjne, ale również wiele form pracy intelektualnej. Systemy AI potrafią dziś analizować dokumenty, generować teksty, interpretować dane i wspierać podejmowanie decyzji biznesowych.

Dla firm oznacza to ogromny potencjał zwiększenia efektywności. Dla pracowników natomiast pojawia się nowe wyzwanie – konieczność dostosowania się do świata, w którym sztuczna inteligencja staje się jednym z podstawowych narzędzi pracy.

Jak sztuczna inteligencja (AI) zmienia rynek pracy

Wpływ sztucznej inteligencji na rynek pracy jest jednym z najczęściej dyskutowanych tematów w świecie technologii i ekonomii. W przeciwieństwie do wcześniejszych fal automatyzacji, które dotyczyły głównie pracy fizycznej, AI zaczyna automatyzować także zadania związane z analizą informacji, komunikacją i tworzeniem treści.

Nie oznacza to jednak, że sztuczna inteligencja całkowicie zastąpi ludzi w pracy. W wielu przypadkach AI działa raczej jako narzędzie wspierające pracowników, pozwalając im wykonywać zadania szybciej i efektywniej.

Jednocześnie rozwój generatywnej AI może znacząco zmienić strukturę zatrudnienia w wielu branżach.

Zawody najbardziej zagrożone przez AI

Niektóre zawody są szczególnie podatne na automatyzację przez sztuczną inteligencję, zwłaszcza jeśli opierają się na powtarzalnych zadaniach związanych z analizą danych lub generowaniem treści.

Copywriting

Jednym z obszarów, w których generatywna AI wywołała największe zmiany, jest tworzenie treści. Modele językowe LLM potrafią generować artykuły, opisy produktów czy teksty marketingowe w ciągu kilku sekund.

Nie oznacza to jednak całkowitego zniknięcia zawodu copywritera. W wielu przypadkach rola człowieka przesuwa się w kierunku redakcji, strategii treści i nadzoru nad działaniem AI.

Obsługa klienta

Systemy AI są coraz częściej wykorzystywane w obsłudze klienta. Chatboty oparte na modelach językowych LLM potrafią odpowiadać na pytania użytkowników, analizować zgłoszenia i rozwiązywać podstawowe problemy.

Dzięki temu firmy mogą obsługiwać tysiące zapytań jednocześnie, co znacząco obniża koszty operacyjne.

Analiza danych

W wielu firmach analiza danych była dotąd wykonywana przez specjalistów przygotowujących raporty i zestawienia statystyczne. Dziś sztuczna inteligencja potrafi automatycznie analizować ogromne zbiory danych i generować wnioski.

Systemy AI mogą identyfikować wzorce, prognozować trendy oraz sugerować decyzje biznesowe na podstawie analizy danych.

Nowe zawody w erze sztucznej inteligencji

Historia technologii pokazuje, że każda rewolucja technologiczna tworzy również nowe zawody. Podobnie jest w przypadku AI. Rozwój generatywnej sztucznej inteligencji powoduje powstawanie zupełnie nowych specjalizacji.

AI engineer

AI engineer to specjalista zajmujący się projektowaniem i wdrażaniem systemów sztucznej inteligencji. Osoby na tym stanowisku pracują nad trenowaniem modeli AI, integracją technologii z systemami informatycznymi oraz optymalizacją algorytmów.

Jest to jeden z najbardziej poszukiwanych zawodów w branży technologicznej.

Prompt engineer

Wraz z rozwojem modeli językowych LLM pojawiła się nowa specjalizacja – prompt engineer. Osoba na tym stanowisku zajmuje się projektowaniem poleceń (promptów), które pozwalają AI generować najbardziej trafne odpowiedzi.

Choć może się to wydawać prostym zadaniem, w praktyce wymaga bardzo dobrej znajomości działania sztucznej inteligencji oraz sposobu interpretowania poleceń przez modele językowe.

AI auditor

Kolejnym nowym zawodem jest AI auditor, czyli specjalista zajmujący się oceną bezpieczeństwa i wiarygodności systemów AI. W miarę jak sztuczna inteligencja staje się coraz ważniejszym elementem infrastruktury cyfrowej, rośnie potrzeba kontrolowania sposobu jej działania.

Audytorzy AI analizują modele pod kątem błędów, uprzedzeń w danych oraz potencjalnych zagrożeń dla użytkowników.

Wpływ AI na produktywność gospodarki

Jednym z najważniejszych efektów rozwoju sztucznej inteligencji jest wzrost produktywności. Dzięki automatyzacji wielu procesów firmy mogą wykonywać więcej pracy przy mniejszym nakładzie czasu i zasobów.

Generatywna AI pozwala na przykład:

-

szybciej tworzyć dokumenty i raporty

-

automatycznie analizować dane

-

wspierać podejmowanie decyzji biznesowych

-

automatyzować komunikację z klientami

W wielu branżach AI działa jako narzędzie zwiększające możliwości pracowników. Zamiast zastępować ludzi, sztuczna inteligencja pozwala im wykonywać zadania, które wcześniej były zbyt czasochłonne lub skomplikowane.

Dlatego wielu ekonomistów uważa, że rozwój AI może doprowadzić do jednej z największych transformacji gospodarczych od czasu rewolucji przemysłowej.

Wpływ sztucznej inteligencji na gospodarkę dopiero zaczyna być widoczny. W kolejnych latach rozwój modeli językowych LLM, robotyki oraz generatywnej AI może całkowicie zmienić sposób funkcjonowania wielu branż.

Dlatego pytanie o przyszłość sztucznej inteligencji staje się jednocześnie pytaniem o przyszłość pracy, biznesu i globalnej gospodarki.